Материал: Sb98837

нии b, при котором y = с + a/(x – b) в координатах y – 1/(x – b) даст расположение точек, наиболее близкое к прямой линии.

3.3. Расчет по экспериментальным данным параметров выбранной аппроксимирующей функции

В общем случае расчет сводится к решению системы нелинейных уравнений. При этом возможно несколько частных случаев.

1. Система уравнений, линейных относительно искомых параметров. Обозначим искомые параметры ak , известные координаты x1,..., xm и y1,..., ym для m искомых точек, а в качестве аппроксимирующей примем модель в виде степенного многочлена:

y = a0 + a1x + a2x2 +...+ ak xk .

Расчет коэффициентов ak сводится к решению системы уравнений, линейных относительно искомых a0,...,ak :

y |

|

= a |

0 |

+ a x |

+ a |

2 |

x2 |

+...+ a |

k |

xk , |

||||||||

1 |

|

|

1 1 |

|

|

|

1 |

|

|

|

1 |

|

||||||

... |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

(3.1) |

|

y |

m |

= a |

0 |

+ a x |

m |

+ a |

2 |

x2 |

+...+ a |

k |

xk . |

|||||||

|

|

|

1 |

|

|

|

|

m |

|

|

|

m |

||||||

2. В качестве аппроксимирующей функции принята модель, не приводящая к системе линейных уравнений:

y = x2ax+b2 .

Путем преобразований yb2 + yx2 = ax , yx2 = ax − yb2 и замены пере-

менных yx2 = Z , b2 = c можно свести расчет a и c к решению системы уравнений:

Z |

1 |

= ax |

−cy |

, |

|

|

|

|

1 |

1 |

|

|

|||

Z |

2 |

= ax |

2 |

−cy |

2 |

, |

(3.2) |

|

|

|

|

||||

... |

|

|

|

|

|

|

|

|

|

= axn −cyn. |

|

||||

Zn |

|

||||||

3. Уравнения системы не сводятся к системе линейных уравнений. Например, при использовании аппроксимирующей функции вида

|

x −b |

2 |

|

|||

y = a exp− |

|

|

|

после выполнения алгебраических преобразований (ло- |

||

c |

||||||

|

|

|

|

|

||

|

|

|

|

|

|

|

21

|

x −b |

2 |

|||

гарифмирования) получается |

ln y = ln a − |

|

|

, т. е. квадратное уравнение |

|

c |

|||||

|

|

|

|

||

относительно искомого b. Заменив переменные c2 ln a −b2 = A , c2 = B , получим систему уравнений, из которой по найденнымA, B можно найти a и c:

x2 |

= 2bx − B ln y + A, |

|

1 |

1 |

1 |

... |

|

(3.3) |

2 |

= 2bxn − B ln yn + A. |

|

xn |

||

При замене переменных следует иметь в виду, что при любой аппроксимации необходимо стремиться минимизировать абсолютные погрешности. При этом относительные погрешности в начале и конце диапазона будут существенно отличаться. Если после этого выполнить подстановку вида Х = 1/х или Y = 1/y, то начало и конец диапазона меняются местами, а следовательно, меняются местами и погрешности. Эти преобразования следует контролировать; в противном случае они могут привести к существенным неточностям.

Рассмотренные графоаналитические методы аппроксимации достаточно просты и позволяют очень быстро получить приближенные значения параметров. Более того, если модель является неподходящей, то графическое построение наглядно показывает, как надо изменить модель или дополнить ее.

В общем случае при построении экспериментальных данных оси координат следует преобразовывать до тех пор, пока не получится прямая линия, по параметрам которой можно найти параметры модели.

3.4. Аналитические методы аппроксимации

Как видно из (3.1)–(3.3), число независимых уравнений системы равно числу поставленных опытов. С другой стороны, для определения k коэффициентов необходимо не менее k независимых уравнений.

Если число поставленных опытов n равно числу искомых коэффициентов k, то решение системы уравнений единственно, а следовательно, случайно, так как точно соответствует случайным значениям исходных данных.

Если n > k, то число уравнений будет избыточным. Из этих уравнений в различных комбинациях можно составить несколько систем уравнений, любая из которых даст свое решение. Но решения всех этих систем будут несовместны, так как любое из них даст свою аппроксимирующую функцию.

22

Следовательно, кривых получится несколько. В этом случае имеется ряд преимуществ:

–этот пучок кривых показывает форму и ширину полосы неопределенности проведенного эксперимента;

–возможно усреднение всех названных кривых, и полученная кривая будет достовернее описывать исследуемое явление, так как она будет свободна от случайных погрешностей, приводивших к разбросу отдельных экспериментальных точек.

3.5. Регрессионный анализ. Метод наименьших квадратов

Регрессионный анализ – статистический метод анализа и обработки экспериментальных данных при воздействии на отклик только количественных факторов, основанный на сочетании аппарата метода наименьших квадратов

итехники статистической проверки гипотез.

Врезультате регрессионного анализа получается регрессионная модель.

Регрессионная модель (модель регрессионного анализа) – это зависи-

мость отклика от количественных факторов и ошибок наблюдения отклика. В этой модели функция отклика является линейной комбинацией базис-

ных функций от фактора.

Полиномиальная модель регрессионного анализа, линейная по парамет-

рам, – это модель, задаваемая полиномом по факторам.

Предположим, что после предварительного анализа была выбрана модель следующего вида:

y′ = a0 +a1x +a2x2.

Значения xi , yi известны. Сделаем подстановку x ≡ x1, x2 ≡ x2 . Тогда уравнение примет вид

y′ = a0 + a1x1 + a2 x2 ,

где y′ – значение функции, рассчитанное по модели.

Отклонение между значением, рассчитанным по модели ( yi′), и значением, полученным в эксперименте ( yi ) (погрешность аппроксимации), будет равно:

∆yi = yi − yi′.

Метод наименьших квадратов (МНК) позволяет найти такие значения

искомых параметров a0 , a1, a2 , при которых ∑n ∆yi2 минимальна: i=1

23

∆yi2 = (yi − yi′)2 = (yi −a0 −a1x1i −a2 x2i )2;

∑n ∆yi2 = ∑n (yi − yi′)2 = ∑n (yi −a0 −a1x1i −a2 x2i )2.

i=1 |

i=1 |

i=1 |

Условие минимума суммы квадратов отклонений означает равенство нулю частных производных по коэффициентам ai :

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

∂ |

∑∆y2 |

|

|

n |

|

|

|

|

|

|

||||

|

|

|

|

|

|

i |

|

|

|

|

|

|

|

|

|||

|

|

|

|

i=1 |

|

|

|

|

= −2∑(yi −a0 −a1x1i |

−a2 x2i ) = 0; |

|

||||||

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

∂a0 |

|

|

|

|

|

i=1 |

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

||||

|

|

∂ |

∑∆yi2 |

|

|

|

n |

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

i=1 |

|

= −2∑(yi |

−a0 −a1x1i −a2 x2i )x1i = 0; |

|

|||||||||||

|

|

|

|

|

|

||||||||||||

|

|

|

|

∂a1 |

|

|

|

|

i=1 |

|

|

|

|

|

|

||

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

||||

|

∂ |

∑∆y2 |

|

|

|

n |

|

|

|

|

|

|

|||||

|

|

|

|

i |

|

|

|

|

|

|

|

|

|

||||

|

|

i=1 |

|

= −2∑(yi |

−a0 −a1x1i −a2 x2i )x2i = 0. |

|

|||||||||||

|

|

|

|

|

|||||||||||||

Тогда |

∂a2 |

|

|

|

|

i=1 |

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

n |

|

n |

|

|

n |

|

|

|

|

|

|

a0n |

+ a1 ∑x1i + a2 ∑x2i |

= |

∑yi ; |

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

i=1 |

|

i=1 |

|

|

i=1 |

|

|

|

|

|

|

n |

|

|

|

|

+ a |

n |

+ a |

n |

x |

n |

(3.4) |

|

|

|

|

|

|

a ∑ x |

|

∑ x2 |

∑ x |

= ∑ x y ; |

||||||||

|

|

|

|

|

0 |

1i |

1 |

1i |

2 |

1i |

|

2i |

1i i |

|

|||

|

|

|

|

|

i=1 |

|

|

|

|

|

i=1 |

|

i=1 |

|

|

i=1 |

|

|

|

|

|

|

n |

|

|

|

|

|

n |

|

n |

|

|

n |

|

|

|

|

|

a0 ∑x2i + a1 ∑x1i x2i + a2 ∑x2 |

= ∑x2i yi . |

|

|||||||||||

|

|

|

|

|

i=1 |

|

|

|

|

i=1 |

|

i=1 |

2i |

i=1 |

|

||

Из (3.4) следуют свойства МНК:

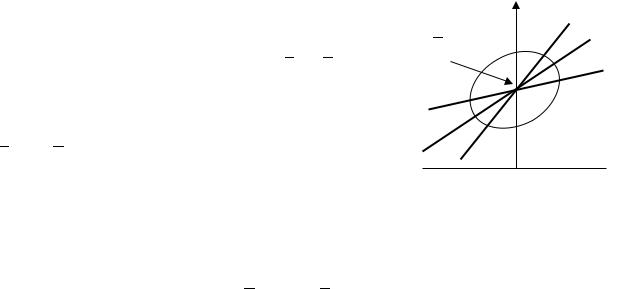

1)первое уравнение будет характеризовать тот факт, что линия регрессии проходит через центр тяжести поля экспериментальных точек (рис. 3.9, прямая 1);

2)второе уравнение будет определять наклон искомой прямой к оси x. При большом количестве переменных xi решение системы уравнений

будет плоскостью в многомерном пространстве. При x = 0 и y = a0 первое

уравнение системы (3.4) будет определять центр тяжести этой плоскости, а остальные уравнения будут характеризовать совместно коэффициенты регрессии.

24

Если до решения системы методом наименьших квадратов все исходные данные центриро-

вать, т. е. найти средние значения x и y , и перенести начало координат в центр тяжести поля экспериментальных точек, то в новых координатах x = 0 , y = a0 = 0 , и из полной системы уравнений исключается и первое уравнение, и первый столбец коэффициентов, а, следовательно, система уравнений упрощается.

Это приводит к следующему:

|

y |

y |

2 |

1 |

3

0 x

0

Рис. 3.9. Линии регрессии

МНК. Штриховой линией показано поле экспериментальных точек (для одной переменной х)

– если средние значения y = a0 и x = x1i найти заранее, то число определяемых коэффициентов уменьшится на единицу;

– такая система удобна во всех тех случаях, когда заранее известно, через какую точку должна проходить поверхность отклика (например, через начало координат).

Особенность МНК состоит в том, что полученные этим методом решения необратимы. Это значит, что линии регрессии x по y и y по x не будут совпадать.

При коэффициенте корреляции, близком к единице, т. е. при малом рассеянии экспериментальных точек и большой протяженности поля экспериментальных точек, линии регрессии x по y и y по x практически совпадают и будут близки к оси эллипса. Если ρ < 0.96 (малое значение коэффициента корреляции), то различие между обеими линиями регрессии становится существенным, а сам метод наименьших квадратов – неэффективным. В таком случае переходят к методу ортогональной регрессии.

МНК чувствителен к неоднородности статистики. Если поле экспериментальных данных неоднородно (например, в результате небрежного проведения измерений, присутствия систематической погрешности, неверного ввода данных), то из-за формальности метода наименьших квадратов можно получить абсурдное решение, даже если имеется всего один промах. Следовательно, МНК применяется только к однородным, очищенным от промахов статическим данным, и до начала расчета необходимо оценить порядок величин.

25