Материал: 1925

относиться к генеральной совокупности. Интервальная оценка генерального среднего (математического ожидания) производится на основе распределения Стьюдента (при числе наблюдений не более 50 − 60) или на основе гипотезы о нормальном распределении (при большем числе наблюдений). Для оценки генеральной дисперсии применяется распределение χ2. Интервал, в котором с заданной вероятностью находится генеральный параметр, называется доверительным интервалом, сама такая вероятность – доверительной вероятностью. Чем точнее требуется результат, тем большим порогом задается исследователь и тем шире (при прочих равных условиях) получается доверительный интервал. В статистике наряду с понятием доверительной вероятности употребляется термин «уровень

значимости». Соответственно применяются три уровня значимости: |

|

0,05; 0,01 и 0,001. |

И |

|

|

Проверка статистических гипотез используется чаще всего для |

|

|

Д |

определения принадлежности двух имеющихся выборок к одной и той же генеральной совокупности.

Гипотеза о том, что обе выборки не различаются, т.е. принадлежат к одной генеральнойАсовокупности, называется иногда нуль-гипотезой. Эта гипотеза принимается, если ее значимость, получаемая на основаниибстатистических критериев, превышает допустимый порог (р > 0,95). Однако при р < 0,95 отвергнуть эту гипотезу нельзя: ответиостается неопределенным, и для получения окончательного вывода тре уются дополнительные данные. Гипотеза отвергается вСтом случае, если ее значимость (вероятность правильности) станов тся меньше заданного стандартного порога.

При проверке статистических гипотез используются параметрические и непараметрические критерии. В первом случае производится сравнение параметров двух выборочных распределений (средних и дисперсий) и делается заключение о равенстве или различии этих параметров в генеральных совокупностях. Гипотеза о равенстве средних значений проверяется по критерию Стьюдента, равенство дисперсий − по критерию Фишера.

В последние годы большую популярность приобрели непараметрические критерии (Уилкоксона, Колмогорова − Смирнова и др.). Их достоинством является то, что они не содержат ограничений, вытекающих из гипотез о типе распределения случайных величин, а опираются на единый принцип – непрерывности распределений.

56

Эти критерии применимы и для анализа порядковых данных. Однако по сравнению с параметрическими методами они менее чувствительны к различиям в выборках. Чаще всего непараметрические критерии используются для сравнения эмпирического распределения с теоретическим, в частности при проверке имеющейся статистической совокупности на принадлежность к типу нормальных распределений.

Дисперсионный анализ – статистический метод, применяемый для выявления влияния отдельных факторов (количественных, порядковых или качественных) на изучаемый признак и оценку степени этого влияния. Если изучается действие количественного фактора, то предварительно производится его разбивка на градации.

Для каждой градации подсчитывается среднее значение изучаемого признака, затем дисперсия среднего Ипо градациям фактора относительно общего среднего и, наконец, общая дисперсия изучаемого показателя (независимо от значения фактора).

В теории дисперсионного анализа показано, что общая дисперсия D равна дисперсии средних по градациям фактора DF (доля дисперсии за счет действия исследуемого фактора – объясненная

дисперсия) плюс остаточная дисперсия за счет действия случайных |

|||||

|

|

|

|

Д |

|

факторов DS: D = DF + DS. Чем больше эта величина, тем сильнее |

|||||

влияние фактора на изучаемый признак. |

|

||||

Для количественной оценкиАстепени влияния вычисляют |

|||||

показатель F по формуле |

|

|

|

|

|

|

б |

|

|

||

и |

⁄(−1) , |

(3.1) |

|||

С |

|

= |

⁄( −1) |

|

|

где L – число градаций фактора; N – объем статистической совокупности.

Показатель влияния F затем сравнивается со стандартным значением Fst в таблице Фишера (для выбранного уровня значимости при соответствующем числе степеней свободы). Если F > Fst, то факт влияния считается достоверно доказанным.

Описанная схема называется однофакторным дисперсионным анализом.

Анализ зависимости между признаками. Для оценки степени взаимозависимости двух количественных признаков чаще всего используют коэффициент ковариации или его нормированное

57

значение − коэффициент корреляции. Коэффициент корреляции Пирсона определяется из зависимости

|

|

= |

|

|

∑ =1( −̅)( − ) |

|

2 |

, |

|

(3.2) |

|||

|

|

|

|

2 |

|

|

|

|

|

|

|||

|

|

|

∑ =1( −̅) |

∑ =1( − ) |

|

|

|

|

|||||

где x |

и y – наблюдения, элементы выборки; |

|

, |

|

– средние значения |

||||||||

наблюденийi i |

; n – количество наблюдений. |

̅ |

|

|

|||||||||

|

При отсутствии связи между признаками величина R равна 0, |

||||||||||||

при |

возрастании степени |

связи |

абсолютная |

величина R |

|||||||||

увеличивается. При наличии детерминированной (функциональной) связи величина R равна +1 или –1 (если увеличение одного признака

значений другого с тем меньшей дисперсиейДИ, чем больше абсолютная величина R. В простейшем виде коэффициент корреляции отражает линейную связь между признаками, когда изменения обоих признаков пропорциональны во всем диапазоне.

сопровождается соответственно увеличением или уменьшением

другого). При промежуточных значениях R каждому фиксированному

значению одного признака отвечает некоторое распределение

может быть равен нулю. В Атаких случаях для выявления связи применяют другой показатель – корреляционное отношение, которое

При наличии нелинейной связи, например при квадратичной зависимости одного признака от другого, коэффициент корреляции

фиксирует налич е любой связи между признаками. Область |

|||

|

б |

|

|

значений одного пр знака разб вается на участки, для каждого из них |

|||

определяется среднееизначение другого признака. Далее вычисляется |

|||

корреляционное отношение |

|

|

|

С |

|

= , |

(3.3) |

|

|

||

где DF – дисперсия второго признака за счет влияния первого; D – общая дисперсия второго признака. Величина корреляционного отношения, как и коэффициента корреляции, лежит между нулем и единицей.

Если исследуется группа тесно связанных между собой признаков, то корреляция между двумя из них может сильно изменяться под влиянием третьего. Частный коэффициент

58

корреляции вычисляется на основе парных коэффициентов |

|||

корреляции: |

( ) = 1− 2 1− 2 |

|

|

|

− |

, |

(3.4) |

где Rxy (z) – частный коэффициент корреляции между признаками Х и Y при нейтрализации влияния признака Z; Rxy, Rxz, Ryz – парные коэффициенты корреляции.

В случае необходимости анализа влияния нескольких признаков на один (множественная корреляция) применяется более громоздкая, требующая больших объемов вычислений процедура.

корреляции – каждому уровню признака присваивается свой ранг, для каждого наблюдения вычисляется разница рангов.

Если исследованию подлежит связь между порядковыми признаками, то применяют так называемыйИранговый коэффициент

интервал значений (если он непрерывенД). При большом числе выборочных данных, значения которых варьируют незначительно, закон распределения может ыть аппроксимирован гистограммой.

Закон распределения случайной величины – это функция,

Для построения гистограммы интервал значений признака

определяющая вероятность того, что какой-либо признак примет заданное значение (если он дискретенА) или попадает в заданный

разбивается на равные участки, для которых подсчитывается частота |

|

С |

|

попадания случайной велбч ны. При бесконечном увеличении числа |

|

наблюдений и участков частота стремится к вероятности, а вид |

|

гистограммы приближаетсяи |

к кривой, выражающей функцию |

плотности (или плотности вероятности) случайной величины.

Законы распределения могут быть одномерными и многомерными. В последнем случае закон описывает вероятность появления сочетанных значений признаков или попадания их в некоторую область пространства признаков. В прикладной статистике особую роль играют несколько наиболее часто используемых законов распределения.

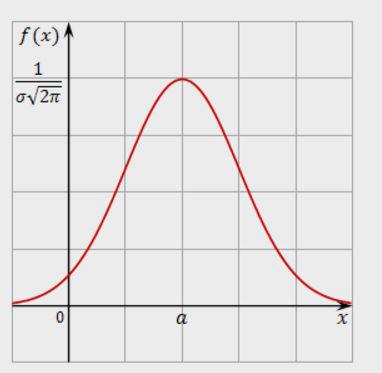

Наиболее разработана гипотеза о нормальном распределении

(закон Гаусса), функция плотности вероятности f (x) которого имеет |

|||||

вид |

( ) = |

√12 exp −( 2− 2)2 , |

(3.5) |

||

|

|

|

|

|

|

|

|

59 |

|

|

|

|

|

|

|

|

|

где a − математическое ожидание; σ – среднеквадратическое (стандартное) отклонение.

Кривая распределения изображена на рис. 3.1. Она симметрична относительно точки x = a (точка максимума). При уменьшении σ координата точки максимума неограниченно возрастает, при этом кривая пропорционально сплющивается вдоль оси абсцисс, так что площадь под её графиком остаётся равной единице (рис. 3.2).

Параметры закона Гаусса a и σ приближенно оцениваются по любой выборке из генеральной совокупности.

Величина σ, возведенная в квадрат, называется дисперсией:

|

D = σ2. |

(3.6) |

Дисперсия |

И |

случайной |

характеризует разброс (вариабельность) |

величины около среднего значения. При нормальном распределении случайной величины ее наблюдаемые значения с большой

вероятностью отклоняются от а в ту или другую сторону не более, |

|||

чем на 3σ (правило трех сигм): (a − 3σ; a + 3σ). |

|||

|

|

|

Д |

|

|

А |

|

|

б |

|

|

и |

|

|

|

С |

|

|

|

Рис. 3.1. Кривая нормального закона распределения (закона Гаусса)

60