Материал: 2334

Задача аппроксимации решается также в автоматизированном режиме посредством специального набора команд в командной стро-

ке MATLAB:

а) команда формирования файл-функции: function z = Da(Vv,da)

z = p00 + p10*Vv + p01*da + p20*Vv.^2 + p11*Vv.*da + p02*da.^2 + p30*Vv.^3 + p21*Vv.^2.*da + p12*Vv.*da.^2 + p03*da.^3;

б) команда запуска аппроксимации: ft = fittype( 'poly33' ); opts = fitoptions( ft ); opts.Weights = zeros(1,0);

[fitresult, gof]=fit( [Vv, da], Da, ft, opts).

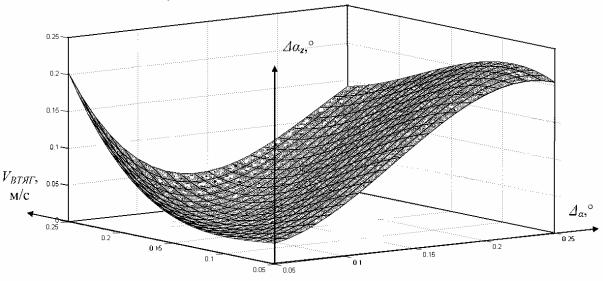

Полученное уравнения регрессии зависимости αz = f(VВТЯГ; α)

для τгп = 0,1с:

αz (VВТЯГ; α) = 0,02542 – 0,5787∙ VВТЯГ + 0,5186∙ α + 16,91∙VВТЯГ |

2 – |

||||

– 12,8∙VВТЯГ ∙ α |

– 1,706∙ α |

2 –51,2∙ VВТЯГ3 + 74,63∙VВТЯГ2∙ α – |

|

||

|

– 51,77∙ VВТЯГ ∙ α |

2 + 27,07∙ α |

3. |

(4.8) |

|

Рис. 4.9. График регрессионной зависимости αz = f(VВТЯГ; α)

При этом R2 = 0,9206. На рис. 4.9 представлен график полученной регрессионной зависимости αz = f(VВТЯГ; α) для значения времени запаздывания гидропривода τгп= 0,1 с.

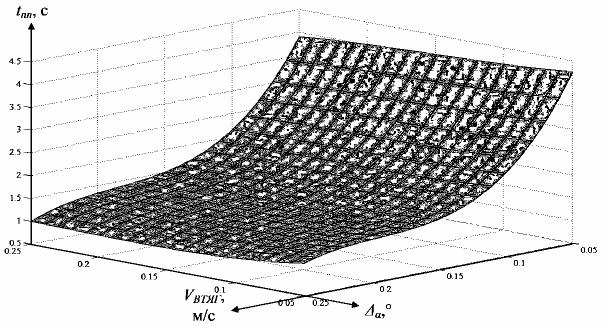

Полученное уравнения регрессии зависимости tпп = f(VВТЯГ; α)

для τгп = 0,1с:

100

tпп (VВТЯГ; α) = 8,281 – 5,783∙VВТЯГ – 99,28∙ α + 24,14∙VВТЯГ |

2 + |

|||||

+ 13,89∙VВТЯГ ∙ α |

+ 502,6∙ α |

2 – 60 ∙VВТЯГ3 + 62,86 ∙VВТЯГ |

2 ∙ α |

– (4.9) |

||

|

– 97,14 ∙VВТЯГ ∙ α |

2 – 853,3∙ α |

3. |

|

|

|

При этом R2 = 0,9993.

На рис. 4.10 представлен график полученной регрессионной зависимости tпп = f(VВТЯГ; α) для значения времени запаздывания гидропривода τгп = 0,1 с.

Рис. 4.10. График регрессионной зависимости tпп = f(VВТЯГ; α)

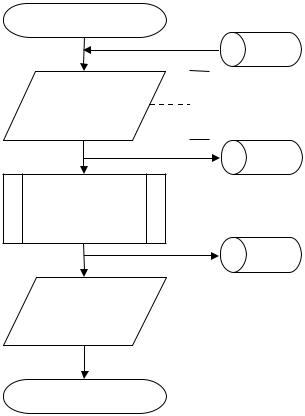

Алгоритм аппроксимации численных зависимостей αz, tпп от

VВТЯГ и α графически представлен в виде блок-схемы на рис. 4.11 и состоит из следующей последовательности действий:

а) чтение массивов входных (VВТЯГ; α) и выходных переменных

αz, tпп;

б) выбор вида уравнения регрессии, запись файл-функции (@ αz, @tпп) с уравнением регрессии в рабочую область MATLAB;

в) расчет коэффициентов уравнений регрессии и коэффициентов детерминации R2, запись их в рабочую область MATLAB;

г) проверка достоверности полученных уравнений по величине

R2.

Полученные уравнения регрессии позволили перейти к поиску оптимальных параметров.

Задачи оптимизации с точки зрения методов решения делятся на два класса [6]:

101

задачи безусловной оптимизации;

задачи условной оптимизации.

Начало αz_nm, tпп_nm, VВТЯГ_n, α_m

Ввод |

Формирование файл- |

уравнения |

функции, содержащей |

регрессии |

уравнение регрессии |

|

|

Расчет @ αz, @tпп коэффициентов

уравнения

регрессии

p00…pij, R2

Вывод p00…pij, R2

Останов

Рис. 4.11. Блок-схема алгоритма аппроксимации зависимостей αz = f(VВТЯГ; α) и tпп = f(VВТЯГ; α)

Задача безусловной оптимизации представляет собой поиск оптимума целевой функции без всяких дополнительных условий и ограничений [22]:

f(x) → min(max). |

(4.10) |

Задача условной оптимизации в общем виде записывается [22]

F f (xj ) → min(max); |

|

|

gi (xj ) ≤bi; |

|

|

|

(4.11) |

|

dj ≤xj ≤Dj; |

|

|

|

|

|

i1,...,m; j 1,...,n.

Всистему уравнений (4.11) входят три составляющие:

целевая функция F = f(xj) показывает, в каком смысле решение должно быть оптимальным, то есть наилучшим, при этом возможны

102

три вида назначения целевой функции: максимизация, минимизация, назначение заданного значения;

ограничения gi(xj)≤bi устанавливают зависимости между переменными;

граничные условия dj≤xj≤Dj показывают, в каких пределах могут находиться значения искомых переменных в оптимальном решении.

При решении задач оптимизации в настоящей работе целевая функция и граничные условия были представлены в следующем виде:

tпп = f(VВТЯГ; α) → min; |

|

αz ≤ αzзад; |

|

0,05 ≤ VВТЯГ ≤ 0,25 м/с; |

(4.12) |

0,05 ≤ α ≤ 0,25 ; |

|

Ri ≥ Rmin;

Lmin пред ≤ Li ≤ Lmax пред.

Для решения задачи условной оптимизации было решено воспользоваться методом множителей Лагранжа, который применим при наличии функциональных ограничений вида [22]

fj = fj (x1, x2,…, xn) = 0, |

(4.13) |

где j = 1, 2,…, m.

Для целевой функции Z (x1, x2,…, xn) справедливо уравнение [22]

dZ |

Z |

dx1 |

Z |

dx2 |

... |

Z |

dxn |

0; |

(4.14) |

|||

|

|

|

||||||||||

|

x |

x |

2 |

|

|

|

x |

n |

|

|

||

1 |

|

|

|

|

|

|

|

|

||||

|

|

|

|

n |

Z |

|

|

|

|

|

|

|

|

|

dZ |

dxi 0. |

|

|

|

(4.15) |

|||||

|

|

|

|

|

|

|||||||

|

|

|

i 1 xi |

|

|

|

|

|

|

|||

Продифференцировав равенство (4.13), получим [22]

n |

f |

|

n |

f |

|

|

||

df1 |

1 |

dxi |

0; ............. |

dfm |

m |

dxi |

0. |

(4.16) |

x |

x |

|||||||

i 1 |

i |

|

i 1 |

i |

|

|

||

Каждое из полученных m уравнений теперь умножим на пока еще неизвестный параметр λ, называемый множителем Лагранжа [22]:

103

n |

f |

|

|

|

||||||

1df1 1 |

1 |

dxi |

0; |

|

|

|||||

x |

|

|||||||||

i 1 |

|

|

i |

|

|

|

||||

n |

|

f2 |

|

|

|

|

|

|||

2df2 2 |

dxi 0; |

|

(4.17) |

|||||||

|

|

|||||||||

i 1 |

|

x |

|

. |

||||||

|

|

|

i |

|

|

|

||||

....................................... |

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

n |

|

|

f |

|

|

|

||||

mdfm m |

m |

dxi 0. |

|

|||||||

x |

|

|||||||||

i 1 |

|

|

|

|

i |

|

|

|

||

Сложив уравнения (4.13) и уравнение (4.16), получим [22]

n |

Z |

|

f1 |

|

f2 |

|

fm |

|

|

|

|

|

|

... m |

|

0. |

(4.18) |

||||

x |

1 x |

2 x |

|

|||||||

|

x dxi |

|||||||||

i 1 |

i |

|

i |

|

i |

|

i |

|

|

|

Поскольку все параметры xi независимы, то для того, чтобы это уравнение удовлетворялось, достаточно, чтобы каждый из n членов равнялся нулю, получаем n уравнений [22]:

Z |

1 |

f1 |

2 |

f2 |

... m |

fm |

0. |

(4.19) |

|

x |

x |

x |

x |

||||||

|

|

|

|

|

|||||

i |

|

i |

|

i |

|

i |

|

|

Таким образом, для перехода к методу множителей Лагранжа необходимо преобразовать ограничения-неравенства в уравнения, после чего целевая функция приобретет вид [22]

F f (xj ) min(max); |

|

|

fi (xj ) 0; |

|

(4.20) |

|

||

i 1,...,m; j 1,...,n. |

|

|

|

|

|

При этом задача оптимизации становится безусловной и |

||

представляется в виде функции Лагранжа [22]: |

|

|

m |

|

|

L(xj; i ) f (xj ) i fi (xj ) min(max); |

(4.21) |

|

i 1 |

|

|

i 1,...,m; j 1,...,n.

Таким образом, была поставлена задача условной оптимизации при помощи задания целевой функции и граничных условий и осуществлен переход от нее к безусловной оптимизации.

104