Материал: А27819 Лазарев В.Л. Робастое управление

через соответствующие им величины энтропий Н1 и Н2 из выражения (8.6). В результате получим

L (1) |

L |

|

e(1) |

|

|

|

e(2) |

|

|

e(1) Xn2 |

e(2) |

Xn1 |

|

|

e(2) |

Xn1 |

|

e(1) Xn2 |

1 |

|

(2) |

Xn1 |

|

Xn2 |

|

Xn1 Xn2 |

|

|

Xn1 Xn2 |

e(2) Xn1 |

|||||||||||

|

|

|

|

|

|

|

(8.29) |

|||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

L |

|

|

|

Xn2 |

еH1 H2 1 |

L |

|

Xn2 |

еI |

1 . |

|

|

|||||

|

|

|

(2) |

|

Xn1 |

(2) |

Xn1 |

|

|

|||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

В выражении (8.29) величина I = Н1 – Н2 |

является мерой коли- |

|||||||||||||||||||

чества информации, порожденной изменением состояния неопределенности системы, ее «информационным следом» на данном этапе.

Из |

выражения |

(8.29) |

следует |

|

L |

|

L |

|

L |

|

X n 2 |

еI 1 , |

||||||||

|

(1) |

(2) |

(2) |

X n1 |

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

или |

L (1) |

|

X n 2 |

еI , или |

|

e(1) X n 2 |

|

X n 2 |

еI . Откуда |

|

|

|

|

|||||||

L ( 2) |

|

X n1 |

X n1 e(2) |

|

X n1 |

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

I |

ln |

|

e(1) |

. |

|

|

|

|

|

|

(8.30) |

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

e(2) |

|

|

|

|

|

|

|

||

Что и требовалось доказать.

Полученному результату (8.30) можно придать дальнейшее развитие. Для этого выразим величины энтропийных потенциалов через соответствующие характеристики рассеяния в соответствии с выражением (8.14). В результате получим

|

|

|

|

|

|

e(1) |

|

Ke(1) |

σ1 |

|

|

σ |

|

|

|

|

D |

|

|

|

|

|

|

I |

ln |

|

ln |

|

|

ln k |

|

ln |

1 |

ln k |

|

ln |

1 |

, |

(8.31) |

||||

|

|

|

|

|

ke |

|

ke |

|

|||||||||||||

|

|

|

|

|

|

|

|

Ke(2) |

σ2 |

|

σ2 |

|

|

|

D2 |

|

|

|

|||

|

|

|

|

|

|

e(2) |

|

|

|

|

|

|

|

|

|

|

|||||

где |

kke |

|

Ke(1) |

|

– коэффициент преобразования закона распределения па- |

||||||||||||||||

|

Ke(2) |

||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

раметра. Значения kke в ряде случаев могут быть определены теоретически, исходя из физического смысла с использованием аналогий и других, а для некоторых типовых ситуаций – заранее вычислены и табулированы. Величина kke характеризует трансформацию закона распределения параметра в статике. В динамике такой процесс будет описываться диф-

156

ференциальным уравнением или соответствующей передаточной функцией WKe ( p) . Поэтому величина kke, например, может быть определена из

передаточной |

функции |

путем перехода |

к |

статическому режи- |

|

му: kke WKe ( p) |

|

p 0 WKe |

(0) . Величины D1 |

и D2, |

входящие в выраже- |

|

|||||

ние (8.31), являются дисперсиями D σ2 . Величина дисперсии характеризует усредненную мощность всего спектра гармоник динамической

составляющей рассматриваемого параметра D |

1 |

S (ω)dω, где S( ) – |

|

|

|||

2π |

|||

|

|

функция спектральной плотности центрированной составляющей, которая описывает распределение среднего значения мощности случайного процесса по гармоникам. С учетом этого обстоятельства полученный результат (8.31) можно рассматривать как базовую модель информационноэнергетического состояния системы.

Как доказано в теореме 3, величины базовых значений Xnl (l L) непосредственно не влияют на величину количества информации I. Тем не менее, как это следует из определения величины КЭП, данные величины могут быть косвенно выражены через величины e и L . Поэтому будет естественным предположить наличие закономерного влияния соотношений указанных величин на величину I. Ответ на этот вопрос дает теорема 4 [20].

Теорема 4. Пусть L (1) и L (2) – величины КЭП, характеризующие отдельные состояния неопределенности системы по какому-либо параметру. Тогда, если L (1) L (2), то количество информации I, порожденное изменением состояния неопределенности системы, будет

превышать величину, равную ln (Xn1/Xn2), и наоборот. Если L (1) = L (2),

то I = ln (Xn1/Xn2).

Доказательство. Из условия L (1)

L (1) |

L |

|

e(1) |

|

e(2) |

|

X n2 e(1) |

X n1 e(2) |

0. |

(8.32) |

(2) |

X n1 |

X n2 |

|

X n1 X n2 |

||||||

|

|

|

|

|

|

|||||

А так как Xn1 0 и Xn2 |

0 (согласно определению 2), из выра- |

|||||||||

жения (8.32) получаем

X n 2 e(1) X n1 e(2) 0, или

e(1) |

|

X n1 |

. |

(8.33) |

|

|

|

||

e( 2) |

|

X n2 |

|

|

157

Выразим входящие в формулу (8.33) величины ЭП через величины соответствующих энтропий на основании выражения (8.6). В результате имеем

eH1 ( x ) |

|

X n1 |

или eH1 H2 |

X n1 |

, или eI |

X n1 |

, |

(8.34) |

|||

eH2 ( x ) |

|

X |

n2 |

X |

n2 |

X |

n2 |

||||

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

|||

где I H1 H2 – количество информации, порожденное изменением состояния неопределенности системы. Логарифмируя обе части неравенства (8.34), получим

I |

ln |

|

X n1 |

. |

(8.35) |

||||

|

|

|

|

||||||

|

|

|

|

|

X n2 |

|

|||

Рассуждая аналогично для условия L (1) |

L (2), имеем |

||||||||

I |

ln |

|

|

X n1 |

. |

(8.36) |

|||

|

|

|

|||||||

|

|

|

|

X n2 |

|

||||

И из условия L (1) = L (2), следуя изложенной схеме рассужде- |

|||||||||

ний, получим |

|

|

|

|

|

|

|

|

|

I |

ln |

|

X n1 |

. |

(8.37) |

||||

|

|

||||||||

|

|

|

|

X n2 |

|

||||

Что и требовалось доказать.

В качестве комментариев к приведенным теоремам 3 и 4 необходимо отметить следующее.

1. Полученный частный результат (8.37) не противоречит утверждению теоремы 3. Действительно, как следует из определе-

ния 2, X n |

e |

. Поэтому, |

подставляя данное выражение для Xn в |

|||||

L |

||||||||

|

|

|

|

|

|

|

||

формулу (8.37) с учетом условия L (1) =L (2), получим |

||||||||

|

|

|

|

X n1 |

|

e(1) |

||

|

|

I |

ln |

|

ln |

|

, |

|

|

|

X n2 |

e(2) |

|||||

что и является утверждением теоремы 3.

158

2.Выводы теорем 2 и 3 справедливы для любых базовых законов распределения, которые могут быть положены в основу определений величин ЭП и КЭП. Переход к новой базе закона распределения приведет к тому, что в выражениях (8.30)–(8.33) величины ЭП будут умножены на одну и ту же величину соответствующего коэффициента перехода. После сокращений получим те же исходные выражения. Поэтому в окончательных результатах указанных теорем коэффициенты переходов отсутствуют.

3.Согласно полученным результатам (8.30), (8.35)–(8.37), величина информации, порождаемая изменением состояний неопределенности, может принимать отрицательные значения. На первый взгляд это противоречит известным положениям теории информации. На самом деле противоречия здесь нет. Дело в том, что классическое определение информации основано на использовании понятий априорной и апостериорной энтропий. Априорная энтропия характеризует исходное состояние неопределенности объекта. Апостериорная энтропия характеризует состояние неопределенности после наступления какого-либо события, уточняющего это состояние. Такими событиями могут являться, например, проведение этапа измерений, прием

сигнала, содержащего дополнительную информацию об объекте, и др. Поэтому значение величины апостериорной энтропии никогда не превышает величины априорной энтропии. Классическое определение количества информации I, порожденной наступлением таких событий, основано на оценке уменьшения состояния неопределенности, которая определяется разностью априорной и апостериорной энтропий. Естественно, что определенное таким образом количество

информации будет являться неотрицательной величиной (I |

0). |

В общем случае рассматривается изменение состояния неопределенности объекта под действием самых различных факторов, определяемых пространственными и временными координатами. При этом уровни состояний неопределенности могут как убывать, так и возрастать. Поэтому величина разности энтропий двух сравниваемых состояний может принимать как положительное, так и отрицательное значение. В частном случае, когда проявление таких факторов обусловливает появление апостериорной энтропии или имеет место уменьшение энтропии последующего состояния, количество информации будет неотрицательно. В дальнейшем, при необходимости,

159

с целью устранения неоднозначности трактовки это обобщенное на основе ТЭП понятие величины информации целесообразно обозначать как IL.

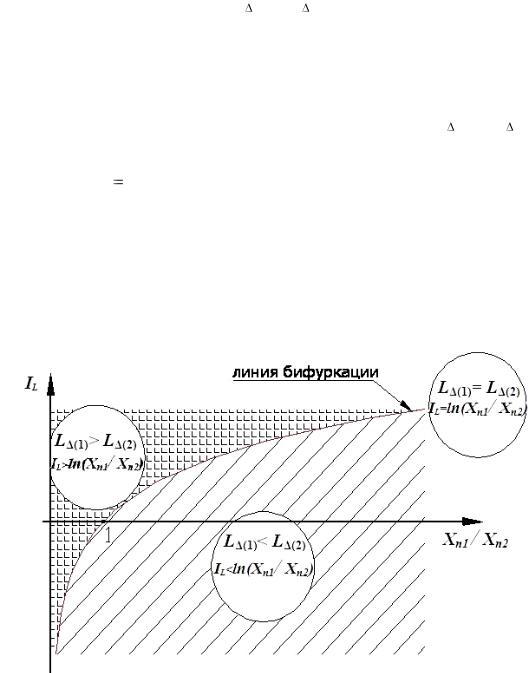

4. На основании результатов теоремы 4 (8.35)–(8.37) можно утверждать, что при использовании величины КЭП для оценки состояния неопределенности условие L (1) = L (2) и соответствующее ему выражение IL = ln(Xn1/Xn2) определяют «линию бифуркации» информационного поля системы. Сказанное проиллюстрировано на рис. 8.4. Здесь в декартовой системе координат Xn1/Xn2 и IL линия IL = ln(Xn1/Xn2) разделяет все пространство возможных значений величины IL системы на две области. В одной области, соответствующей условию L (1)  L (2), область возможных значений величины IL будет располагаться над графи-

L (2), область возможных значений величины IL будет располагаться над графи-

ком функции I |

|

ln |

X n1 |

, в другой области – наоборот. Нахождение |

|

L |

X n2 |

||||

|

|

|

|||

|

|

|

|

изображающей точки на указанной разделительной линии соответствует ситуации, когда значение величины IL будет однозначно определяться из выражения (8.37) на основании соотношения базовых значений параметров. Таким образом, относительно данной линии осуществляется фрагментация информационного поля системы.

Рис. 8.4. Фрагментация структуры информационного поля системы в зависимости от соотношений величин КЭПов и базовых значений параметров

160