Материал: 6593

136

различения в пользу H1 против H2 |

при Fâ |

→ ∞ и ∆t → 0 |

||||||||

|

|

n |

1 |

|

|

(k ) |

(k ) |

|

2 |

|

I (1:2)= lim |

∑ |

|

|

|

|

− x2 |

|

|

. |

|

|

|

|

|

|||||||

|

|

x1 |

|

|

||||||

|

∆t→0 |

k =1 |

2N0 Fâ |

|

|

|

|

|

||

Внесем множитель ∆t =1 (2Fâ ) под знак суммы и заметим,

(2Fâ ) под знак суммы и заметим,

что ее пределом является определенный интеграл, вычисленный на интервале (0,T)

|

|

|

|

|

1 |

|

n |

|

2 |

|

|

I |

|

(1:2)= |

|

lim |

∑[x1 |

(tk ) − x2 |

(tk )] |

∆t |

= |

||

|

N0 |

||||||||||

|

|

|

|

|

∆t→0 |

k =1 |

|

|

|

|

|

|

|

|

1 |

T∫[x1(t) − x2 (t)]2 dt. |

|

|

|

||||

|

|

|

|

|

|

|

|||||

|

|

|

N0 0 |

|

|

|

|

|

|

|

|

Таким образом, величина средней информации для различения двух сообщений известной формы на фоне аддитивного белого шума зависит только от интенсивности шума и от квадрата расстояния между этими двумя сообщениями (сравните с результатами примера 5.1.1).

5.2 Информация по Фишеру

Определение. Свойства. Пусть сообщение X есть непрерывная случайная величина, а сигнал y = y(1) ,..., y(n) характери-

зуется условной плотностью вероятности W (y(1) ,..., y(n) / x). Рассмотрим две гипотезы:

H1 – передано сообщение x1, то есть W1 =W (y(1) ,..., y(n) / x1) , H2 – передано сообщение x2, то есть W2 =W (y(1) ,..., y(n) / x2 ) .

Среднюю информацию в пользу H1, вычисленную по фор-

муле (5.1.2)

I(1: 2) = ∞∫... ∞∫W (y(1)

−∞ −∞

log W (y(1) ,...,

W (y(1) ,...,

,...,

y(n) y(n)

y(n) / x1)

(5.2.1)

/x1) dy(1) ,..., dy(n) ,

/x2 )

можно формально рассматривать как функцию аргумента x2,

137

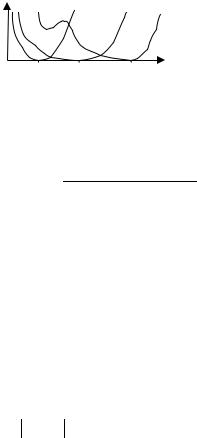

I(x1:x2)

x1'

IF (x)

|

|

|

|

|

зависящую от параметра x1. На |

|

|

|

|

|

|

рис.5.2 в качестве примера |

|

|

|

|

|

|

приведен возможный вид этой |

|

|

|

|

|

|

функции при различных значе- |

|

|

|

|

|

|

ниях x1. |

|

|

x1'' |

x1''' x2 |

|

Если существует вторая |

||

Рис. 5.2 |

|

|

|

производная этой функции по |

||

|

|

|

+∞ |

+∞ |

x2 в точке x2= x1= x, |

|

|

∂2 I(x : x ) |

|

||||

= |

= − ∫ |

... ∫ |

W (y[1] ,..., y[n] / x) |

|||

12 |

2 |

|||||

|

∂x2 |

|

−∞ |

−∞ |

(5.2.2) |

|

|

|

|

||||

∂2 lnW (y[1] ,2..., y[n] / x) dy[1]...dy[n].

∂x

то ее величина называется информацией по Фишеру о параметре x, содержащейся в сигнале y.

То же значение информации можно получить в результате вычисления по формуле

+∞ |

+∞ |

|

|

|

|

|

|

|

IF (x) = ∫ |

... ∫W (y[1] ,..., y[n] / x) |

|

|

|

|

(5.2.3) |

||

−∞ |

−∞ |

|

|

|

|

|

||

|

|

|

|

|

|

|||

∂lnW (y[1] ,..., y[n] / x) 2 |

dy |

[1] |

...dy |

[n] |

. |

|||

|

|

|

|

|

|

|||

|

∂x |

|

|

|||||

|

|

|

|

|

|

|

||

Выбор одной из двух формул определяется только удобством вычислений. Информация Фишера показывает, насколько быстро возрастает функция I(x1:x2) при увеличении

∆x = x1 − x2 и, следовательно, является мерой различимости

близких значений x1 и x2.

Информация Фишера, как и информация Кульбака, обладает свойствами выпуклости и аддитивности. Единицы измерения информации Фишера – это единицы измерения величины х-2.

Неравенство Рао-Крамера. Это – главный результат теории информации по Фишеру.

Рассмотрим задачу оценки непрерывного сообщения x. Правило оценивания сводится к тому, что каждому значению

выборки y = y(1) ,..., y(n) ставится в соответствие некоторое значение оцениваемого параметра x. Таким образом, оценка

138

xˆ(y(1) ,..., y(n) ) является функцией выборочных данных и поэто-

му также является случайной величиной. Обычно вычисляют следующие числовые характеристики оценки:

1) Математическое ожидание при условии, что истинное значение сообщения равно x,

+∞ |

+∞ |

|

m(x) = ∫ |

... ∫ xˆ(y[1] ,..., y[n] ) W (y[1] ,..., y[n] / x) dy[1]...dy[n]. |

(5.2.4) |

−∞ |

−∞ |

|

2) Смещение |

(5.2.5) |

|

|

b(x) = m(x) − x, |

|

т.е. систематическую ошибку, сопутствующую выбранному правилу оценивания.

3) Дисперсию, вычисляемую также при условии, что истинное значение сообщения равно x,

|

+∞ |

+∞ |

|

|

|

2 |

|

|

|

D(x) = |

∫ |

... |

∫ |

xˆ |

(y[1] |

,..., y[n] ) −m(x) |

|

(5.2.6) |

|

|

|

|

|

|

|

|

|||

|

−∞ |

−∞ |

|

|

|

|

|

|

|

W (y[1] ,..., y[n] / x) dy[1]...dy[n].

Дисперсия оценки является основной количественной мерой точности оценивания.

Пусть функция правдоподобия W (y(1) ,..., y(n) / x) диффе-

ренцируема по параметру x, информация Фишера (5.2.2) существует и не равна нулю для всех значений параметра в окрестности точки x, тогда дисперсия и смещение любой оценки связаны с информацией Фишера неравенством Рао-Крамера

|

|

+ |

db(x) |

2 |

|

|

|

1 |

dx |

|

(5.2.7) |

||

D(x) ≥ |

|

|

|

. |

||

|

IF (x) |

|

||||

|

|

|

|

|

||

Для несмещенных оценок (b(x)=0) или для оценок с постоянным, не зависящим от x смещением (b(x)=c), числитель в (5.2.7) равен единице и тогда

D(x) ≥ |

1 |

. |

(5.2.8) |

|

|||

|

IF (x) |

||

|

|

||

Таким образом, информация Фишера является количественной мерой предельной, потенциальной точности оценива-

139

ния непрерывного сообщения x, так как дисперсия несмещенной оценки не может быть меньше величины, обратной информации Фишера.

Неравенства (5.2.7) и (5.2.8) обращаются в равенства тогда

итолько тогда, когда одновременно выполняются два условия:

1)Функция правдоподобия выборки может быть представлена в виде

W (y |

[1] |

,..., y |

[n] |

/ x) = h(y |

[1] |

,..., y |

[n] |

) f xˆ (y |

[1] |

,..., y |

[n] |

), x , |

|

(5.2.9) |

||||

|

|

|

|

|

|

|

|

|

|

|||||||||

где h(y[1] ,..., y[n] ) |

– некоторая функция выборки y, |

не завися- |

||||||||||||||||

щая от x и xˆ , |

|

|

|

|

|

|

|

|

|

ˆ |

|

|

|

|

). |

|||

|

|

ˆ |

– функция, зависящая только от x |

|

[1] |

,..., y |

[n] |

|||||||||||

f [x, x] |

и x(y |

|

|

|||||||||||||||

Оценка |

xˆ (y[1] ,..., y[n] ), |

удовлетворяющая |

условию |

(5.2.9), |

||||||||||||||

называется достаточной, поскольку она сохраняет всю информацию о x, содержащуюся в самой выборке.

2) Функция правдоподобия выборки такова, что для любо-

го x выполняется соотношение |

|

|

|

||

|

∂lnW (y[1] ,..., y[n] / x) |

= k(x) xˆ |

(y[1] ,..., y[n] )−m(x) |

, |

(5.2.10) |

|

∂x |

||||

|

|

|

|

|

|

где k(x) – некоторая функция x.

Оценка, удовлетворяющая этому уравнению, называется эффективной, а семейство распределений, задаваемых уравнением (5.2.10) при различных значениях x, называется экспоненциальным семейством. Легко убедиться, что эффективная оценка всегда достаточна, но обратное утверждение неверно.

Среди всех оценок с заданным смещением именно эффективные оценки обладают минимальной дисперсией. К сожалению, эффективная оценка существует далеко не во всех случаях, и тогда потенциальная точность оценивания сообщения недостижима.

Оценка максимального правдоподобия. Метод макси-

мального правдоподобия широко используется на практике. В качестве оценки xˆ (y[1] ,..., y[n] ) выбирается такое значение x,

при котором функция правдоподобия W (y[1] ,..., y[n] / x) дости-

140

гает наибольшего значения. Это значит, что в качестве оценки максимального правдоподобия выбирается решение уравнения правдоподобия

∂W (y[1] ,..., y[n] / x) |

= 0 или |

∂lnW (y[1] ,..., y[n] / x) |

= 0. |

(5.2.11) |

|

∂x |

∂x |

||||

|

|

|

Доказано, что если эффективная оценка существует, то она может быть реализована методом максимального правдоподобия.

РЕШЕНИЕ ТИПОВЫХ ПРИМЕРОВ

Пример 5.2.1. Случайная величина Y имеет экспоненциальное распределение

W (y / x) = |

1 exp(− |

y |

), y 0 ≥. |

|

|||

|

x |

x |

|

а) Найти максимально правдоподобную оценку математического ожидания m этой случайной величины.

б) Найти статистические характеристики (математическое ожидание и дисперсию) этой оценки.

в) Определить, является ли оценка достаточной. г) Определить, является ли оценка эффективной.

д) Найти информацию Фишера и по неравенству Рао-Кра- мера проверить сделанное заключение об эффективности оценки.

Решение. Запишем уравнение правдоподобия

∂lnW (y / x) |

= |

∂ |

−ln x − |

y |

= − |

1 |

+ y |

1 |

= |

1 |

(y − x) = 0. |

||||

|

|

|

|

|

|

|

|

|

|

||||||

∂x |

|

|

x |

x |

2 |

x |

2 |

||||||||

|

∂x |

|

x |

|

|

|

|

|

|

||||||

Отсюда xˆ(y) = y , т.е. максимально правдоподобная оценка

математического ожидания равна наблюдаемому выборочному значению y .

По |

формуле |

(5.2.4) |

находим математическое ожидание |

||||

|

|

∞ |

1 |

|

|

y |

|

оценки |

m(x) = |

y |

|

exp |

− |

|

dy = x . |

|

|

||||||

|

|

∫0 |

x |

|

|

x |

|

Таким образом, оценка xˆ(y) является несмещенной. Дисперсию оценки вычисляем по формуле (5.2.5)