Материал: Разработка веб-приложения для прогнозирования временных рядов методом фрактального анализа

На

рисунке 1.3 показана аналогичная кривая для ![]() -

значения, часто наблюдаемого в природных процессах. Эти данные были получены

аппроксимацией обобщенного броуновского движения. Такой ряд получен, с учетом

памяти о 200 наблюдениях. Данные имитируют естественный цикл из 200 наблюдений.

-

значения, часто наблюдаемого в природных процессах. Эти данные были получены

аппроксимацией обобщенного броуновского движения. Такой ряд получен, с учетом

памяти о 200 наблюдениях. Данные имитируют естественный цикл из 200 наблюдений.

Рисунок

1.3 - R/S-анализ: фрактальное броуновское движение. Фактическое значение ![]() , оценка

, оценка ![]()

Рисунок

1.4 - R/S-анализ: фрактальное броуновское движение. Фактическое значение ![]() , оценка

, оценка ![]()

Благодаря своей замечательной устойчивости, показатель Херста широко применяется в анализе временных рядов сложных систем. Он содержит минимум предположений об изучаемой системе и позволяет ввести классификацию временных рядов безотносительно к их виду распределения.

Выделяют

три интервала значений показателя Херста:

а) При ![]() . Данный диапазон соответствует антиперсистентным

(эргодическим) рядам. Такой тип системы часто называют - «возврат к среднему».

Если система демонстрирует рост в предыдущий период, то, скорее всего, в следующем

периоде начнется спад. И наоборот, если шло снижение, то вероятен близкий

подъем. Устойчивость такого антиперсистентного поведения зависит от того,

насколько

. Данный диапазон соответствует антиперсистентным

(эргодическим) рядам. Такой тип системы часто называют - «возврат к среднему».

Если система демонстрирует рост в предыдущий период, то, скорее всего, в следующем

периоде начнется спад. И наоборот, если шло снижение, то вероятен близкий

подъем. Устойчивость такого антиперсистентного поведения зависит от того,

насколько ![]() близко к нулю. Чем ближе его значение к нулю, тем

ближе

близко к нулю. Чем ближе его значение к нулю, тем

ближе ![]() к

к ![]() , или

отрицательной корреляции. Такой ряд более изменчив, или волатилен, чем ряд

случайный.

, или

отрицательной корреляции. Такой ряд более изменчив, или волатилен, чем ряд

случайный.

б) При ![]() . Указывает на случайный ряд (броуновское движение,

случайные блуждания). События некоррелированы между собой (

. Указывает на случайный ряд (броуновское движение,

случайные блуждания). События некоррелированы между собой (![]() ), настоящее не влияет на будущее. Функция плотности

вероятности может быть нормальной кривой, однако, это не обязательное условие.

), настоящее не влияет на будущее. Функция плотности

вероятности может быть нормальной кривой, однако, это не обязательное условие.

в) При ![]() . Значения показателя

. Значения показателя ![]() ,

принадлежащие данному диапазону, характерны для персистентных или

трендоустойчивых рядов. Они характеризуются наличием долговременных корреляций

между текущими событиями и событиями будущими. Если ряд возрастает (убывает) в

предыдущий период, то вероятно, что он будет сохранять эту тенденцию какое-то

время в будущем. Сила персистентности, увеличивается при приближении

,

принадлежащие данному диапазону, характерны для персистентных или

трендоустойчивых рядов. Они характеризуются наличием долговременных корреляций

между текущими событиями и событиями будущими. Если ряд возрастает (убывает) в

предыдущий период, то вероятно, что он будет сохранять эту тенденцию какое-то

время в будущем. Сила персистентности, увеличивается при приближении ![]() к 1, или 100% корреляции (

к 1, или 100% корреляции (![]() ). Чем ближе

). Чем ближе ![]() к 0.5,

тем более зашумлен ряд и тем менее выражен его тренд. Персистентный временной

ряд является фракталом, поскольку может быть описан как обобщенное броуновское

движение или смещенные случайные блуждания.

к 0.5,

тем более зашумлен ряд и тем менее выражен его тренд. Персистентный временной

ряд является фракталом, поскольку может быть описан как обобщенное броуновское

движение или смещенные случайные блуждания.

Персистентные временные ряды являют собой наиболее интересный класс, так как

оказалось, что они не только в изобилии обнаруживаются в природе, - это

открытие принадлежит Херсту, - но и свойственны рынкам капитала. Фрактальная

размерность временного ряда, или накопленных изменений при случайном блуждании,

равна ![]() . Фрактальная размерность кривой линии равна

. Фрактальная размерность кривой линии равна ![]() , а фрактальная размерность геометрической плоскости

равна

, а фрактальная размерность геометрической плоскости

равна ![]() . Таким образом, фрактальная размерность случайного

блуждания лежит между кривой линией и плоскостью.

. Таким образом, фрактальная размерность случайного

блуждания лежит между кривой линией и плоскостью.

Показатель

Херста может быть преобразован во фрактальную размерность с помощью следующей

формулы: ![]() .

.

Таким

образом, если ![]() , то

, то ![]() . Обе

величины характеризуют независимую случайную систему. Величина

. Обе

величины характеризуют независимую случайную систему. Величина ![]() будет соответствовать фрактальной размерности, более

близкой к кривой линии. Это персистентный временной ряд, дающий более гладкую,

менее зазубренную линию, нежели случайное блуждание. Антиперсистентная величина

будет соответствовать фрактальной размерности, более

близкой к кривой линии. Это персистентный временной ряд, дающий более гладкую,

менее зазубренную линию, нежели случайное блуждание. Антиперсистентная величина

![]() дает соответственно более высокую фрактальную

размерность и более прерывистую линию, чем случайное блуждание, и,

следовательно, характеризует систему, более подверженную переменам.

дает соответственно более высокую фрактальную

размерность и более прерывистую линию, чем случайное блуждание, и,

следовательно, характеризует систему, более подверженную переменам.

Метод нормированного размаха заключается в следующем:

а)

Пусть имеем временной ряд, состоящий из цен закрытия фондового индекса, длины М.

Преобразуем его во временной ряд длины ![]() из

логарифмических отношений.

из

логарифмических отношений.

б)

Разделим период времени N на А смежных подпериодов длины n,

так, что ![]() . При этом N, A

и n подбираются таким образом, чтобы

. При этом N, A

и n подбираются таким образом, чтобы ![]() было целочисленным значением. Пометим каждый

подпериод Ia с учетом того что

было целочисленным значением. Пометим каждый

подпериод Ia с учетом того что ![]() . Введем

двойной индекс - каждый элемент Ni в Ia переобозначим Nk,a,

. Введем

двойной индекс - каждый элемент Ni в Ia переобозначим Nk,a, ![]() . Для каждого Ia

длины n среднее по интервалу значение определяется как

. Для каждого Ia

длины n среднее по интервалу значение определяется как  .

.

в)

Находим элементы временного ряда накопленных отклонений (Xk,a) от

среднего значения для каждого подпериода Ia:

![]() ;

;

г)

Диапазон определяется как максимальное значение за вычетом минимального

значения Xk,a в пределах

каждого подпериода Ia: ![]() .

.

д)

Выборочное стандартное отклонение рассчитывается для каждого подпериода Ia:  ;

;

е)

Каждый диапазон RIa

теперь нормализуется путем деления на соответствующее SIa.

На шаге (2) мы получили смежные подпериоды длины n.

Следовательно, среднее значение (R/S)n определяется как ![]() ;

;

ж)

Длина n итеративно увеличивается до следующего более высокого

значения. Шаги (2-6) повторяются до ![]() .

Получаем два вектора:

.

Получаем два вектора: ![]() и

и ![]() .

.

з)

Теперь на основе значений, полученных на предыдущем шаге, применим регрессию к

уравнению ![]() , где c = const, а H - показатель Херста. Предварительно логарифмируем обе

части уравнения регрессии. Отрезок, отсекаемый на координатной оси, является

оценкой log©, константой. Наклон прямой является оценкой

показателя Херста Н.

, где c = const, а H - показатель Херста. Предварительно логарифмируем обе

части уравнения регрессии. Отрезок, отсекаемый на координатной оси, является

оценкой log©, константой. Наклон прямой является оценкой

показателя Херста Н.

1.3 Псевдофазовая реконструкция

Обработку хаотических процессов можно разделить на ряд этапов. Первый этап - расчет экспоненты Херста, что позволит идентифицировать анализируемый временной ряд как случайный, персистентный или антиперсистентный.

Второй этап - это определение размерности пространства вложения и временной задержки сигнала. Определение параметров вложения обеспечивает максимальную предсказуемость временного ряда и может быть использовано для выбора оптимального размера окна (количество входных элементов) в прогнозирующей нейронной сети.

Третий этап - моделирование. Используя результаты предыдущих этапов, можно осуществить прогнозирование и псевдофазовую реконструкцию хаотического процесса.

Псевдофазовая реконструкция в частности описана в работе Кесияна Г.А. и Шахмеликяна Т.А. «Анализ и моделирование хаотических процессов в экономике».

Авторы рассмотрели применение хаотических процессов на фондовом рынке с последующим прогнозированием котировок посредством нейросетевых технологий.

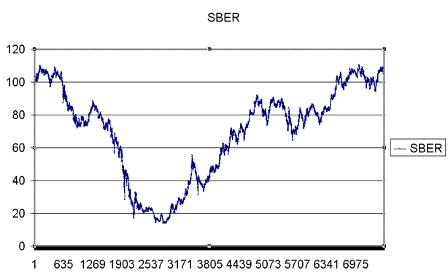

Для численных экспериментов были взяты котировки обычных акций Сбербанка за период с 20.07.2007 по 04.08.2011 с интервалом час (длина ряда равна N=7926). График исходных данных показан на рисунке 1.5 .

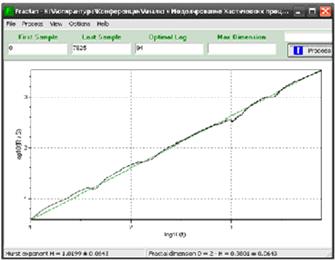

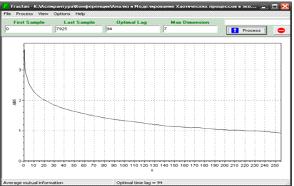

На первом этапе была рассчитана экспонента Херста с помощью программного продукта Fractan 4.4 (рисунок 1.6).

Рассчитанные значения для экспоненты Херста получились

примерно ≈1. Это означает, что временной ряд является персистентным, то

есть характеризуется эффектами долговременной памяти.

Рисунок 1.5 - Данные для анализа: обычные акции Сбербанка

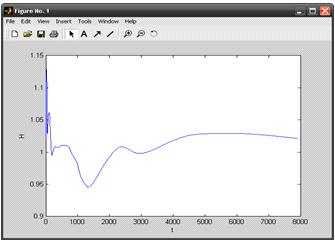

Кроме этого, по экспоненте Херста можно судить о

необходимом объеме обучающей выборки, применяемой в нейросетевых технологиях.

Необходимый объем выборки соответствует номеру ряда, при котором система

максимально накопила память, то есть это максимальное значение в системе

координат, где по оси абсцисс отложено время t, а по оси ординат значения экспоненты Херста H. Не учитывая начальные всплески

графика, максимальное значение экспоненты Херста достигается при t = 5826 (Рисунок 1.7).

Рисунок 1.6 -

Расчет экспоненты Херста

Рисунок 1.7 - Определение объема обучающей выборки с помощью параметра Херста

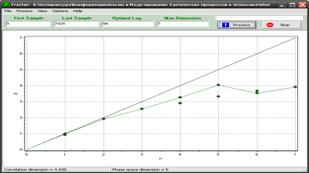

Для определения размерности пространства вложений

авторы вычислили вначале фрактальную размерность с помощью метода

корреляционной размерности. Корреляционная размерность для акций Сбербанка

оказалась равной d=4.030 (Рисунок

1.8). Размерность пространства вложений m можно рассчитать по следующей формуле: m=2[d]+1= 2*[4.030]+1=9.

Рисунок 1.8 - Вычисление фрактальной (корреляционной)

размерности

При выборе временной задержки τ метод автокорреляционной функции не всегда является оптимальным, так как вместо свойства независимости использует неэквивалентное ему свойство некоррелированности, поэтому авторы воспользовались более точным методом взаимной информации.

Программный продукт Fractan 4.4 с помощью метода взаимной информации рассчитал

оптимальную задержку τ=94 (Рисунок 1.9).

Рисунок 9 - Вычисление оптимальной задержки методом взаимной информации

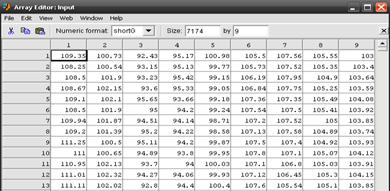

Далее в ППП Matlab 6.5 авторы реализовали алгоритм, осуществляющий псевдофазовую

реконструкцию с заданными параметрами m и τ. В результате работы алгоритма из исходного ряда длиной 7926

получили девятимерный временной ряд длиной N9=N-(m-1)*τ

= 7926-(9-1)*94 = 7174. Часть

девятимерного ряда продемонстрирована на рисунке 1.10.

Рисунок 1.10 - Результат псевдофазовой реконструкции

акций Сбербанка

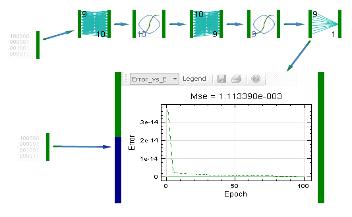

Далее, в качестве базовой архитектуры для

прогнозирования временного процесса они создали двухслойный персептрон в среде Peltarion Synapse 1.5.0 (Рисунок 1.11). В результате применения

генетических алгоритмов оптимизации получили ошибку обучения 0.0011.

Рисунок 1.11 - Двухслойный персептрон

График выходов сети по обучающей выборке показан в Приложении 1. Видно, что выходы нейронной сети (кривая сиреневым цветом) и действительные значения (кривая черным цветом) достаточно близки. График выходов сети по тестовой выборке (ряд с 5827 номера) продемонстрирован в Приложении 2.

Результаты тестирования искусственной нейронной сети говорят о высокой точности прогнозирования курса обычных акций Сбербанка с применением теории хаоса при подготовке обучающей выборки [19].

1.4 Виды нейронных сетей

Теория нейронных сетей включают широкий круг вопросов из разных областей науки: биофизики, математики, информатики, схемотехники и технологии. Поэтому понятие "нейронные сети" детально определить сложно.

Искусственные нейронные сети (НС) - совокупность моделей биологических нейронных сетей. Представляют собой сеть элементов - искусственных нейронов - связанных между собой синоптическими соединениями. Сеть обрабатывает входную информацию и в процессе изменения своего состояния во времени формирует совокупность выходных сигналов.

Работа сети состоит в преобразовании входных сигналов во времени, в результате чего меняется внутреннее состояние сети и формируются выходные воздействия. Обычно НС оперирует цифровыми, а не символьными величинами.

Большинство моделей НС требуют обучения. В общем случае, обучение - такой выбор параметров сети, при котором сеть лучше всего справляется с поставленной проблемой. Обучение - это задача многомерной оптимизации, и для ее решения существует множество алгоритмов.

Искусственные нейронные сети - набор математических и алгоритмических методов для решения широкого круга задач. Выделим характерные черты искусственных нейросетей как универсального инструмента для решения задач:

а) НС дают возможность лучше понять организацию нервной системы человека и животных на средних уровнях: память, обработка сенсорной информации, моторика.

б) НС - средство обработки информации:

а. гибкая модель для нелинейной аппроксимации многомерных функций;

б. средство прогнозирования во времени для процессов, зависящих от многих переменных;

в. классификатор по многим признакам, дающий разбиение входного пространства на области;

г. средство распознавания образов;

д. инструмент для поиска по ассоциациям;

е. модель для поиска закономерностей в массивах данных.

в) НС свободны от ограничений обычных компьютеров благодаря параллельной обработке и сильной связанности нейронов.

г) В перспективе НС должны помочь понять принципы, на которых построены высшие функции нервной системы: сознание, эмоции, мышление.

Биологический нейрон - сложная система, математическая модель которого до сих пор полностью не построена. Введено множество моделей, различающихся вычислительной сложностью и сходством с реальным нейроном.

Одна из важнейших - формальный нейрон (Рисунок

1.12). Несмотря на простоту ФН, сети, построенные из таких нейронов, могут

сформировать произвольную многомерную функцию на выходе.

Рисунок 1.12 - Формальный нейрон

Нейрон состоит из взвешенного сумматора и нелинейного элемента.

Функционирование нейрона определяется формулами:

|

|

|

|

|

|

где хi - входные сигналы, совокупность всех входных сигналов нейрона образует вектор x;i - весовые коэффициенты, совокупность весовых коэффициентов образует вектор весов w;- взвешенная сумма входных сигналов, значение NET передается на нелинейный элемент;

Ө - пороговый уровень данного нейрона;- нелинейная функция, называемая функцией активации.

Нейрон имеет несколько входных сигналов x и один выходной сигнал OUT. Параметрами нейрона, определяющими его работу, являются: вектор весов w, пороговый уровень Ө и вид функции активации F.

а) Жесткая ступенька (Рисунок 1.13):

![]()

Используется в классическом формальном нейроне. Развита полная теория, позволяющая синтезировать произвольные логические схемы на основе ФН с такой нелинейностью. Функция вычисляется двумя-тремя машинными инструкциями, поэтому нейроны с такой нелинейностью требуют малых вычислительных затрат. Эта функция чрезмерно упрощена и не позволяет моделировать схемы с непрерывными сигналами. Отсутствие первой производной затрудняет применение градиентных методов для обучения таких нейронов. Сети на классических ФН чаще всего формируются, синтезируются, т.е. их параметры рассчитываются по формулам, в противоположность обучению, когда параметры подстраиваются итеративно.