Материал: Нейроинформатика и нейросистемы

Обучающий вектор, обучающая выборка: Вектор входных сигналов искусственного нейрона и, возможно, ожидаемое значение выходного сигнала искусственного нейрона, используемый в процессе обучения искусственного нейрона.

Предположим, что i-ыйинстар был обучен на

единственной положительной эталонной паре . ![]() При

этом вектор входных весов инстара

При

этом вектор входных весов инстара ![]() .

В режиме классификации на вход инстара подается вектор

.

В режиме классификации на вход инстара подается вектор ![]() ,

тогда на выходе вырабатывается сигнал

,

тогда на выходе вырабатывается сигнал

![]() .

.

Поскольку входные векторы ![]() и

и

![]() нормализованы

(т.е.

нормализованы

(т.е. ![]() ),

то выходной сигнал инстара равен просто косинусу угла между векторами

),

то выходной сигнал инстара равен просто косинусу угла между векторами ![]() и

и

![]() .

.

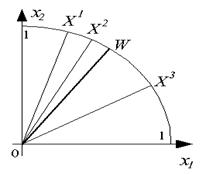

Функционирование инстара наглядно иллюстрируется

графически. В режиме обучения при предъявлении, например, трех положительных

примеров, содержащих двухкомпонентные векторы![]() ,

,

![]() и

и![]() , подбирается вектор входных весов W, представляющий собой

"усреднение" этих входных векторов, как это показано на рис. 14.

, подбирается вектор входных весов W, представляющий собой

"усреднение" этих входных векторов, как это показано на рис. 14.

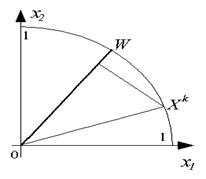

В режиме классификации при подаче на вход

инстара очередного вектора ![]() определяется

степень его близости к "типичному" вектору W в виде косинуса угла

между этими векторами, как это показано на рис. 15.

определяется

степень его близости к "типичному" вектору W в виде косинуса угла

между этими векторами, как это показано на рис. 15.

Рис. 14 Результат обучения инстара Гроссберга

Рис. 15 Классификация входного вектора обученным

инстаром Гроссберга

Обучение инстара Гроссберга без учителя

предполагает случайный выбор начальных значений входных весов ![]() и

их нормализацию, подобную нормализации вектора входных сигналов X. Дальнейшее

уточнение весов реализуется следующей формулой:

и

их нормализацию, подобную нормализации вектора входных сигналов X. Дальнейшее

уточнение весов реализуется следующей формулой:

![]() (9)

(9)

2.2.4 Нейроны типа WTA <#"785937.files/image077.jpg">

Рис. 16. Структурная схема слоя

нейронов типа WTA

Каждый конкурирующий нейрон в группе

получает одни и те же входныесигналы. Каждый нейрон рассчитывает выходной

сигнал своего сумматора обычным образом ![]() . По результатам сравнения всех

. По результатам сравнения всех ![]() ,

, ![]() выбирается

нейрон-победитель, обладающий наибольшим значением

выбирается

нейрон-победитель, обладающий наибольшим значением ![]() . Выходной

сигнал

. Выходной

сигнал ![]() нейрона-победителя

получает значение 1, выходные сигналы всех остальных нейронов - 0.

нейрона-победителя

получает значение 1, выходные сигналы всех остальных нейронов - 0.

Для обучения нейронов типа WTA не требуется учитель, оно практически полностью аналогично обучению инстара Гроссберга. Начальные значения весовых коэффициентов всех нейронов выбираются случайным образом с последующей нормализацией относительно 1.

При предъявлении каждого обучающего

вектора ![]() определяется

нейрон-победитель, что дает ему право уточнить свои весовые коэффициенты по

упрощенному (в силу бинарности

определяется

нейрон-победитель, что дает ему право уточнить свои весовые коэффициенты по

упрощенному (в силу бинарности ![]() ) правилу Гроссберга

) правилу Гроссберга

![]() (10)

(10)

Все проигравшие нейроны оставляют свои весовые коэффициенты неизменными.

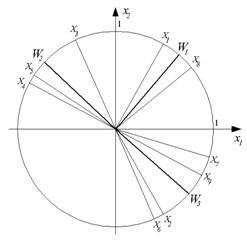

Понятно (см. инстар Гроссберга), что

в каждом цикле обучения побеждает тот нейрон, чей текущий вектор входных весов ![]() наиболее

близок входному вектору

наиболее

близок входному вектору ![]() . При этом

вектор

. При этом

вектор![]() корректируется

в сторону вектора

корректируется

в сторону вектора ![]() . Поэтому в

ходе обучения каждая группа близких друг другу входных векторов (кластер)

обслуживается отдельным нейроном.

. Поэтому в

ходе обучения каждая группа близких друг другу входных векторов (кластер)

обслуживается отдельным нейроном.

Рис. 17. Результат обучения слоя

нейронов типа WTA

Серьезная проблема в использовании нейронов типа WTA - возможность возникновения "мертвых" нейронов, т.е. нейронов, ни разу не победивших в конкурентной борьбе в ходе обучения и поэтому оставшихся в начальном состоянии. Для исключения "ложных" срабатываний в режиме классификации мертвые нейроны после окончания обучения должны быть удалены.

Для уменьшения количества мертвых

нейронов (и, следовательно, повышения точности распознавания) используется

модифицированное обучение, основанное на учете числа побед нейронов и

шрафовании наиболее "зарвавшихся" среди них. Дисквалификация может

быть реализована либо назначением порога числа побед, после которого слишком

активный нейрон "засыпает" на заданное число циклов обучения, либо

искусственным уменьшением величины ![]() пропорционально числу побед.

пропорционально числу побед.

2.2.5

Нейрон Хебба

<#"785937.files/image091.gif"> (11)

где ![]() - коэффициент обучения, значение

которого выбирается из интервала (0, 1). Правило

Хебба

<javascript:termInfo(%22%D0%BD%D0%B5%D0%B9%D1%80%D0%BE%D0%BD%20%D0%A5%D0%B5%D0%B1%D0%B1%D0%B0%22)>

(Искусственный нейрон, использующий для своего обучения непосредственную

корреляцию входных и выходного сигналов) применимо для нейронов с различными

функциями активации

<javascript:termInfo(%22%D1%84%D1%83%D0%BD%D0%BA%D1%86%D0%B8%D1%8F%D0%BC%D0%B8%20%D0%B0%D0%BA%D1%82%D0%B8%D0%B2%D0%B0%D1%86%D0%B8%D0%B8%22)>.

Обучение нейрона может производиться как с учителем, так и без него. В первом

случае в правиле Хебба вместо фактического значения выходного сигнала

- коэффициент обучения, значение

которого выбирается из интервала (0, 1). Правило

Хебба

<javascript:termInfo(%22%D0%BD%D0%B5%D0%B9%D1%80%D0%BE%D0%BD%20%D0%A5%D0%B5%D0%B1%D0%B1%D0%B0%22)>

(Искусственный нейрон, использующий для своего обучения непосредственную

корреляцию входных и выходного сигналов) применимо для нейронов с различными

функциями активации

<javascript:termInfo(%22%D1%84%D1%83%D0%BD%D0%BA%D1%86%D0%B8%D1%8F%D0%BC%D0%B8%20%D0%B0%D0%BA%D1%82%D0%B8%D0%B2%D0%B0%D1%86%D0%B8%D0%B8%22)>.

Обучение нейрона может производиться как с учителем, так и без него. В первом

случае в правиле Хебба вместо фактического значения выходного сигнала ![]() используется

ожидаемая реакция

используется

ожидаемая реакция![]() .

.

Особенностью правила Хебба является

возможность достижения весом![]() произвольно большого значения за

счет многократного суммирования приращения в циклах обучения. Одним из способов

стабилизации процесса обучения по Хеббу служит уменьшение уточняемого веса

произвольно большого значения за

счет многократного суммирования приращения в циклах обучения. Одним из способов

стабилизации процесса обучения по Хеббу служит уменьшение уточняемого веса ![]() на величину,

пропорциональную коэффициенту забывания

на величину,

пропорциональную коэффициенту забывания![]() . При этом правило Хебба принимает

вид

. При этом правило Хебба принимает

вид

![]() (12)

(12)

Значение коэффициента забывания ![]() выбирается

из интервала (0,1), рекомендуется соблюдать условие

выбирается

из интервала (0,1), рекомендуется соблюдать условие ![]() .

.

К сожалению, при обучении по правилу

Хебба нейрона с линейной функцией активации стабилизация не достигается даже

при использовании забывания. В 1991 г. Е. Ойя предложил модификацию правила

Хебба, имеющую следующий вид:

![]() (13)

(13)

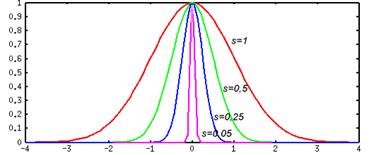

2.2.6 Радиальный нейрон <#"785937.files/image100.jpg">

Рис. 18. Структурная схема

радиального нейрона

(Радиальный нейрон: Искусственный нейрон, в качестве функции, активации которого выступает радиальная функция (обычно, функция Гаусса))(Радиальная искусственная нейронная сеть: Двухслойная искусственная нейронная сеть, первый слой которой составляют радиальные нейроны, а второй - линейные).

Здесь ![]() - радиальная функция с центром в

точке с координатами

- радиальная функция с центром в

точке с координатами ![]() . Такие

функции разнообразны, но на практике чаще всего используется функция Гаусса,

имеющая следующий вид:

. Такие

функции разнообразны, но на практике чаще всего используется функция Гаусса,

имеющая следующий вид:

![]() , (14)

, (14)

где ![]() - эвклидова норма расстояния между

входным вектором X и центром

- эвклидова норма расстояния между

входным вектором X и центром ![]() нейрона,

нейрона, ![]() - параметр,

определяющий "ширину" функции. На рис. 19 даны графики этой функции в

скалярном варианте для различных значений

- параметр,

определяющий "ширину" функции. На рис. 19 даны графики этой функции в

скалярном варианте для различных значений ![]() .

.

Рис. 19. График одномерной

радиальной функции

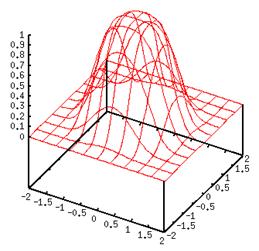

На рис. 20 дан график для двух

входных сигналов.

Рис. 20. График двумерной радиальной

функции

Принципиальное отличие радиального нейрона от сигмоидального нейрона и персептрона в том, что они разбивают многомерное пространство входных сигналов гиперплоскостью, а радиальный - гиперсферой.

Обучение радиального нейрона

заключается в подборе параметров радиальной функции ![]() и

и ![]() . Подробно

алгоритм обучения сетей на основе радиальных нейронов приведен в модуле

Радиальныенейронныесети. В качестве примера приведем выражение, часто

используемое для корректировки положения центра нейрона после предъявления k-ого

обучающего вектора

. Подробно

алгоритм обучения сетей на основе радиальных нейронов приведен в модуле

Радиальныенейронныесети. В качестве примера приведем выражение, часто

используемое для корректировки положения центра нейрона после предъявления k-ого

обучающего вектора

![]() (15)

(15)

где ![]() - коэффициент обучения

- коэффициент обучения ![]() . Причем

такому уточнению подвергается только центр, ближайший к входному вектору

. Причем

такому уточнению подвергается только центр, ближайший к входному вектору ![]() (подобный

подход используется и при обучении нейронов типа WTA

<javascript:termInfo(%22%D0%BD%D0%B5%D0%B9%D1%80%D0%BE%D0%BD%D0%BE%D0%B2%20%D1%82%D0%B8%D0%BF%D0%B0%20WTA%22)>).

(подобный

подход используется и при обучении нейронов типа WTA

<javascript:termInfo(%22%D0%BD%D0%B5%D0%B9%D1%80%D0%BE%D0%BD%D0%BE%D0%B2%20%D1%82%D0%B8%D0%BF%D0%B0%20WTA%22)>).

.3

Классификация искусственных нейронных сетей

Искусственная нейронная сеть в общем случае характеризуется следующими параметрами:

o Адаптивная обучаемость. В контексте искусственной нейронной сети обучаемость означает, что сеть может усваивать различные варианты поведения в зависимости от того. Какие данные поступают на ее вход. Вместо того чтобы диктовать сети, как она должна реагировать на каждую порцию данных (как это было бы в случае обычного программирования), сеть сама находит сходства и различия в поступающих данных. По мере поступления новых данных обучение продолжается, и поведение сети изменяется.

o Самоорганизация. По мере того как данные поступают на вход сети, сеть имеет возможность изменять весовые коэффициенты тех или иных соединений. Тем самым, по мере поступления новых данных, практически изменяется структура сети. Эффективность самоорганизации сети зависит от начальной структуры соединений и выбранного в качестве математической модели алгоритма обучения (тренинга)

o Устойчивость к ошибкам. Искусственная нейронная сеть умеет выделять из потока данных важные свойства и усиливать их, при этом слабо реагируя на случайные, искаженные или совершенно новые данные (свойства). Таким образом, данные, не несущие в себе повторяющихся закономерностей (другими словами, помехи), просто отбрасываются нейронной сетью. Обеспечивая тем самым устойчивость к ошибкам.

o Работа в режиме реального времени и параллельная обработка информации. Эти преимущества нейронных сетей проявляются только в промышленном исполнении (когда каждый нейрон действительно представляет собой отдельный процессор) и не могут быть получены при программной эмуляции нейронов.

Объединенные (путем передачи сигналов с выходов одних искусственных нейронов на входы других) между собой нейроны образуют искусственную нейронную сеть (ИНС).

Существует много вариантов построения ИНС. Для их классификации используются следующие основные критерии:

1. тип нейронов, составляющих сеть;

2. количество слоев нейронов в сети;

. направление передачи сигналов в сети;

. вид обучающих выборок ![]() ;

;

. назначение сети.

Сеть, состоящая целиком из нейронов одного типа, называется однородной, если же в ней комбинируются слои нейронов разного типа, то она - гибридная.

Сеть, все нейроны которой расположены в одной "плоскости" (т.е. отсутствует хотя бы одна непосредственная связь выхода одного нейрона со входом другого), называется однослойной, иначе она - многослойная.

Сеть называется однонаправленной, если в ней отсутствуют обратные связи (т.е. нет передачи сигнала с последующих слоев на предыдущие). Сеть с обратными связями называется рекуррентной.

Если для обучения сети используется стратегия с

учителем и ![]() , то сеть

называется гетероассоциативной. Если же

, то сеть

называется гетероассоциативной. Если же ![]() ,

то сеть - автоассоциативна.[3]

,

то сеть - автоассоциативна.[3]

Основными признаками для классификации

искусственных нейронных сетей являются архитектура и связанный с ней алгоритм

обучения. По этим признакам искусственные нейронные сети можно классифицировать

так, как это показано на рис 21.

Рис. 21. Классификация нейронных сетей[1]

В этой классификации можно отметить несколько моментов.

o Обучение с учителем - класс искусственных нейронных сетей, для которого заранее известен диапазон выходных данных. В случае, когда после преобразования входных данных и получения выходных данных последние не укладываются в заранее заданные диапазон значений, нейронная сеть получает сигналы обратной связи и корректирует свою структуру с целью уменьшения ошибки.

Пример. При распознавании изображений оператор (человек или электронное устройство) сообщает нейронной сети, правильно или нет, она распознала изображение.

o Обучение без учителя - класс искусственных нейронных сетей, для которого диапазон выходных значений не задан и обучение сети проводится только на основании закономерностей, обнаруженных во входных сигналах.

o Многослойный перцептрон - искусственная нейронная сеть, состоящая из

· входного слоя нейронов, на которые поступают входные сигналы;

· выходного слоя нейронов, передающего выходные сигналы на интерфейс пользователя;

· скрытых слоев нейронов, расположенных между входным и выходным слоями;

· механизма (или алгоритма ) обратного распространения, обеспечивающего при наступлении ошибки ( несовпадении выходного сигнала с шаблоном) последовательную корректировку всех весовых коэффициентов связей, начиная с ближнего к выходному скрытого слоя и заканчивая входным слоем, с целью устранения этой ошибки.

o Сеть с радиально-базисной функцией -

искусственная нейронная сеть, имеющая, кроме входного и выходного, один скрытый

слой и использующая в качестве активационной функции нейронов скрытого слоя

радиально-базисную функцию(РБФ), которая в общем виде выглядит так:

![]() (16)

(16)

o Байесовская сеть - искусственная нейронная сеть, использующая в качестве математической модели сеть Байеса, связывающую между собой множество переменных (весовых коэффициентов) и их вероятностных зависимостей (активационных функций).

o Самоорганизующиеся карты Кохонена - искусственные нейронные сети, осуществляющие последовательное (по мере обучения) группирование сходных данных в плоской системе координат таким образом, что к завершению обучения узлы, содержащие сходные данные, располагаются геометрически в непосредственной близости друг от друга. Данный подход позволяет эффективно выделить главные данные. подавив случайные шумы и ошибки.