Материал: Нейроинформатика и нейросистемы

Нейроинформатика и нейросистемы

ОГЛАВЛЕНИЕ

Введение

Глава 1 Нейрокомпьютеры

.1 Нейрокомпьютеры, и их применение в современном обществе

.2 Некоторые характеризующие нейрокомпьютеры свойства. Задачи, решаемые с помощью нейрокомпьютеров

Глава 2. Искусственные нейронные сети

.1 Математическая модель нейрона

.2 Типы искусственных нейронов

.2.1 Персептрон

.2.2 Сигмоидальный нейрон

.2.3 Инстар Гроссберга

.2.4 Нейроны типа WTA

.2.5 Нейрон Хебба

.2.6 Радиальный нейрон

.3 Классификация искусственных нейронных сетей

.4 Достоинства и недостатки искусственных нейронных сетей

Заключение

Список используемой литературы

Введение

Актуальность исследования: Нейроиформатика - область научных исследований, лежащая на пересечении нейронаук <#"785937.files/image001.jpg">

Рис. 1 Биологический нейрон

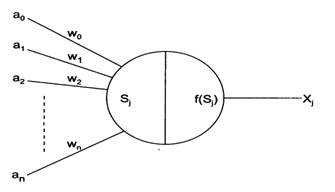

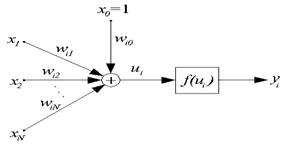

Абстрагируя принцип работы биологического нейрона, математики построили математическую модель, отражающую основные принципы работы этой клетки (рис 2)

В этой модели сигналы, поступающие

на входы ![]() , умножаются

на весовые коэффициенты

, умножаются

на весовые коэффициенты ![]() , и на

основе функции обработки

, и на

основе функции обработки![]() вырабатывается

выходной сигналXj

вырабатывается

выходной сигналXj![]() . В простейшем случае входные

сигналы, помноженные на весовые коэффициенты, суммируются, и, когда значение

суммы становится больше определенного порога, генерируется выходной сигнал.

. В простейшем случае входные

сигналы, помноженные на весовые коэффициенты, суммируются, и, когда значение

суммы становится больше определенного порога, генерируется выходной сигнал.

Рис. 2 Классическая модель

искусственного нейрона

В других случаях зависимость выходного сигнала от суммы входных может иметь более сложный характер, описываемый заданной математической функцией.

Физически один искусственный нейрон

представляет собой простой микропроцессор с возможность программирования

функции ![]() установки

весовых коэффициентов и с небольшим объемом встроенной памяти. Для обработки

знаний отдельный искусственный нейрон применен быть не может. Но когда

множество искусственных нейронов соединяются между собой в искусственную

нейронную сеть (подобно тому, как биологические нейроны соединены в мозгу

человека), у них появляется возможность обрабатывать и накапливать знания.

Знания в искусственной нейронной сети накапливаются в виде значений весовых

коэффициентов.

установки

весовых коэффициентов и с небольшим объемом встроенной памяти. Для обработки

знаний отдельный искусственный нейрон применен быть не может. Но когда

множество искусственных нейронов соединяются между собой в искусственную

нейронную сеть (подобно тому, как биологические нейроны соединены в мозгу

человека), у них появляется возможность обрабатывать и накапливать знания.

Знания в искусственной нейронной сети накапливаются в виде значений весовых

коэффициентов.

Таким образом, можно сформулировать определение.

Искусственная нейронная сеть - это математическая модель вместе с ее аппаратной и программной реализацией, построенная по принципу действия биологической нейронной сети и предназначенная для установления взаимосвязанности данных[1].

Исходя из этого определения, необходимыми элементами искусственной нейронной сети являются:

§ Математическая модель;

§ Искусственные нейроны (реализованные аппаратно или программно);

§ Программно-топологическая реализация математической

модели за счет задания соединений между нейронами и обрабатывающей

(активационной ) функции![]() .

.

2.2 Типы искусственных

нейронов

Ниже приведены типы искусственных нейронов,приведенныев учебном курсе «Искусственные нейронные сети»[7].

· Персептрон

· Сигмоидальный нейрон

· Инстар Гроссберга

· Нейроны типа WTA

· Нейрон Хебба

· Радиальный нейрон

2.2.1 Персептрон <#"785937.files/image008.jpg">

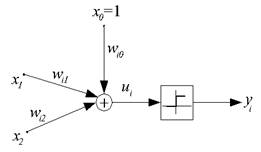

Рис. 3. Структурная схема персептрона

Выходной сигнал

(Величина, характеризующая реакцию

искусственного нейрона на вектор его входных сигналов) нейрона может принимать

только два значения {0,1} по следующему правилу:

![]()

![]()

Обучение персептрона требует

учителя, т.е. множества ![]() пар векторов

входных сигналов

пар векторов

входных сигналов ![]() (Вектор

величин, подаваемых одновременно на входы искусственного нейрона), и соответствующих

им ожидаемым значениям выходного сигнала

(Вектор

величин, подаваемых одновременно на входы искусственного нейрона), и соответствующих

им ожидаемым значениям выходного сигнала ![]() . Обучение (отыскание весовых

коэффициентов

. Обучение (отыскание весовых

коэффициентов ![]() ) сводится к

задаче минимизации целевой функции

) сводится к

задаче минимизации целевой функции

![]() (1)

(1)

К сожалению, для персептрона в силу

разрывности функции ![]() при

отыскании минимума

при

отыскании минимума ![]() применимы

методы оптимизации только нулевого порядка.

применимы

методы оптимизации только нулевого порядка.

На практике для обучения персептрона чаще всего используется правило персептрона (Процедура обучения искусственной нейронной сети, построенной на базе персептронов), представляющее собой следующий простой алгоритм.

1. Выбираются (как правило, случайно)

начальные значения весов ![]() (

(![]() = 0, 1, 2, ..., N) нейрона.

= 0, 1, 2, ..., N) нейрона.

2. Для каждой обучающей пары ![]() выполняется

ряд циклов (их номера обозначим через t) уточнения значений входных весов

(синаптический вес: Величина, характеризующая степень влияния входного сигнала

искусственного нейрона на его поведение (на величину его выходного сигнала)) по

формуле:

выполняется

ряд циклов (их номера обозначим через t) уточнения значений входных весов

(синаптический вес: Величина, характеризующая степень влияния входного сигнала

искусственного нейрона на его поведение (на величину его выходного сигнала)) по

формуле:

![]() (2)

(2)

Где![]()

![]()

![]()

Процесс обработки текущей обучающей пары завершается

· либо на цикле, в котором все ,![]()

· либо после достижения предельного количества циклов.

Следует отметить, что правило персептрона

представляет собой частный случай предложенного много позже универсального правила обучения Видроу-Хоффа(Универсальное

правило корректировки входных весов искусственной нейронной сети в режиме

обучения "онлайн")

![]() (3)

(3)

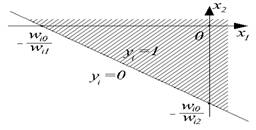

Функционирование обученного персептрона в режиме классификации легко проиллюстрировать графически на примере двухвходового нейрона с поляризацией, структурная схема которого дана на рис. 4.

Для такого нейрона ![]() Это

выражение определяет плоскость в трехмерном пространстве

Это

выражение определяет плоскость в трехмерном пространстве ![]() ,

эта плоскость пересекается с плоскостью

,

эта плоскость пересекается с плоскостью ![]() по

линии, определяемой уравнением

по

линии, определяемой уравнением ![]() как это показано на

рис. 5.

как это показано на

рис. 5.

Рис. 4 Структурная схема двухвходового

персептрона

Эта линия разбивает пространство входных

сигналов ![]() на

две области: в одной из них (заштрихованной) значения

на

две области: в одной из них (заштрихованной) значения ![]() ,

и, следовательно, функция активации (Функция, вычисляющая значение выходного

сигнала искусственного нейрона, используя в качестве аргумента взвешенную сумму

входных сигналов искусственного нейрона) принимает значение 1; в другой -

,

и, следовательно, функция активации (Функция, вычисляющая значение выходного

сигнала искусственного нейрона, используя в качестве аргумента взвешенную сумму

входных сигналов искусственного нейрона) принимает значение 1; в другой - ![]() ,

и

,

и ![]() .

.

Рис. 5 Разделение пространства входных данных

двухвходовым персептроном

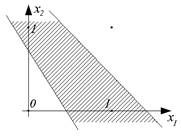

Таким образом, наглядно видно, что персептрон

является простейшим линейным классификатором. С его помощью можно обеспечить,

например, классификацию, реализующую логические функции "И" и

"ИЛИ" над входами ![]() и

и ![]() ,

как это показано на рис. 6.

,

как это показано на рис. 6.

Рис. 6 Реализация логических функций Ии ИЛИ двухвходовым персептроном

нейрокомпьютер сеть искусственный

Однако реализовать логическую функцию

"исключающее ИЛИ" двухвходовым персептроном уже невозможно (см. рис.

7).

Рис. 7 Разделение пространства входных данных

для реализации функции "исключающее ИЛИ"

2.2.2

Сигмоидальный нейрон

<#"785937.files/image016.gif">.

Структурная схема нейрона данного типа представлена на рис. 8.

Рис. 8 Структурная схема

сигмоидального нейрона

В качестве функции активации ![]() выступает

сигмоидальная функция (т.е. функция, график которой похож на букву

"S"). На практике используются как униполярные, так и биполярные

функции активации.

выступает

сигмоидальная функция (т.е. функция, график которой похож на букву

"S"). На практике используются как униполярные, так и биполярные

функции активации.

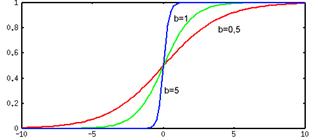

Униполярная функция, как правило,

представляется формулой

![]() , (4)

, (4)

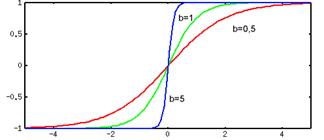

тогда как биполярная функция

задается в виде

![]()

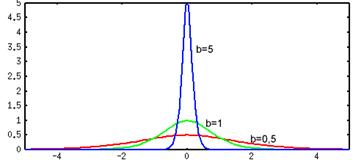

Графики униполярных и биполярных

сигмоидальных функций представлены на рис. 9 и рис. 10 соответственно.

Рис. 9 График униполярной

сигмоидальной функции

Рис. 10 График биполярной

сигмоидальной функции

Коэффициент b определяет "крутизну" функций и выбирается разработчиком сети (на практике b для упрощения назначают обычно равным 1).

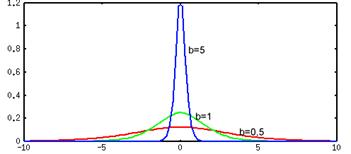

Производная униполярной функции

активации имеет вид

![]()

а производная биполярной функции -

![]()

Графики производных имеют

колоколобразный вид и представлены на рис. 11 и рис. 12.

Рис. 11 График производной униполярной сигмоидальной функции

Рис. 12 График производной

биполярной сигмоидальной функции

Для обучения сигмоидального нейрона

используется стратегия "с учителем" (Способ обучения искусственной

нейронной сети путем предъявления ей серии эталонных обучающих выборок и

векторов ожидаемых значений выходных сигналов), однако, в отличие от

персептрона, для поиска минимума целевойфункции (1),здесь используются методы

поисковой оптимизации первого порядка, в которых целенаправленное изменение

весовых коэффициентов ![]() осуществляется

в направлении отрицательного градиента

осуществляется

в направлении отрицательного градиента ![]() .

.

j-ая компонента вектора градиента

имеет вид

![]() (5)

(5)

Обозначив![]() , имеем

, имеем ![]()

Также возможно обучение

сигмоидального нейрона и дискретным способом - сериями циклов уточнения входных

весов (синаптический вес) для каждой эталонной пары ![]() (см. правило

персептрона). При этом коррекция весов после каждого цикла выполняется по

следующей формуле:

(см. правило

персептрона). При этом коррекция весов после каждого цикла выполняется по

следующей формуле:

![]() ,

,

где ????- коэффициент обучения, значение которого выбирается из диапазона (0, 1).

Необходимо напомнить, что все методы

поисковой оптимизации первого порядка - это методы локального поиска, не

гарантирующие достижения глобального экстремума. В качестве попытки преодолеть

этот недостаток было предложено обучение с моментом, в котором коррекция весов

выполняется следующим образом:

![]() (6)

(6)

Последнее слагаемое в формуле

называется моментом и характеризует фактическое изменение веса в предыдущем

цикле (![]() выбирается

в диапазоне (0, 1)). Существует надежда, что при приближении к точке локального

минимума (где градиентная составляющая

выбирается

в диапазоне (0, 1)). Существует надежда, что при приближении к точке локального

минимума (где градиентная составляющая ![]() стремится к нулю) составляющая

момента выведет поиск из области локального минимума в более перспективную

область.

стремится к нулю) составляющая

момента выведет поиск из области локального минимума в более перспективную

область.

2.2.3 Инстар Гроссберга <#"785937.files/image059.jpg">

Рис. 13 Структурная схема инстара

Гроссберга

Особенностями инстара, отличающими его от нейронов других типов, являются следующие:

1. функция активации ![]() часто

линейна, т.е.

часто

линейна, т.е. ![]()

2. входной вектор X нормализован так, что его эвклидова норма равна 1;

. обучение инстара возможно как с учителем, так и без него.

Нормализация элементов вектора X производится по

следующей формуле:

(7)

(7)

Обучение инстара с учителем производится

дискретно по правилу Гроссберга

![]() (8)

(8)

где ????-

коэффициент обучения, значение которого выбирается в диапазоне (0, 1). В

качестве начальных обычно выбираются нулевые значения весовых коэффициентов.

Необходимо обратить внимание, что на изменение значений весовых коэффициентов

оказывают влияние только положительные примеры эталонных пар, для которых ![]()

На процесс обучения инстара решающее влияние

оказывает величина коэффициента обучения ????.

При ????=1

веса ![]() принимают

значения соответствующих входов

принимают

значения соответствующих входов ![]() текущей эталонной

пары за один цикл обучения (при этом происходит абсолютное

"забывание" предыдущих значений

текущей эталонной

пары за один цикл обучения (при этом происходит абсолютное

"забывание" предыдущих значений ![]() .При

.При

![]() в

результате обучения коэффициенты

в

результате обучения коэффициенты![]() принимают

некоторые "усредненные" значения обучающих векторов

принимают

некоторые "усредненные" значения обучающих векторов![]() , k = 1, 2, ..., p.

, k = 1, 2, ..., p.