Материал: Лабораторна робота №8 Персептрон

|

|

Лабораторна робота №8 |

|

|

Персептрони та одношарові персептронні нейронні мережі |

||

Мета |

роботи: |

Вивчення основного елементу нейронної мережінейрона, |

|

принципів |

побудови |

на основі нейрона простої |

нейронної мережіперсептрона і |

освоєння базових прийомів моделювання персептрона в |

середовищі MATLAB. |

||

ЗАГАЛЬНІ ВІДОМОСТІ

Нейрон персептрона. Простий нейрон

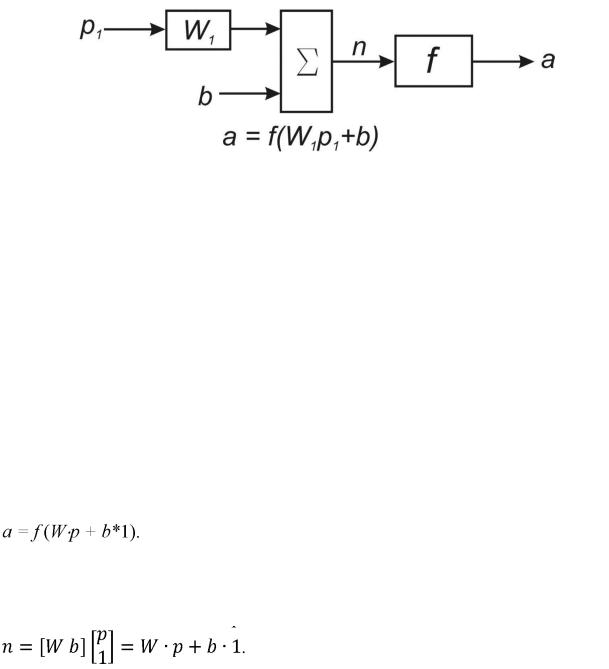

Елементарним осередком нейронної мережі єнейрон. Структура нейрона з єдиним скалярним входом показана на мал. 1.

Малюнок 1

Скалярний вхідний сигналр множиться на скалярнийваговий коефіцієнт W, і результуючий зважений вхід W·p є аргументом функції активації нейрона f, яка породжує скалярний вихід а.

Нейрон, показаний на мал. 1, доповнений скалярним зсувом b. Зсув підсумовується із зваженим входом W·p і приводить до зрушення аргументу функції на величинуb. Дію зсуву можна звести до схеми зважування, якщо уявити, що нейрон має другий вхідний

сигнал із значенням, рівним 1 (b·1). Вхід п функції активації нейрона як і раніше залишається скалярним і рівним сумі зваженого входу і зсуву b. Ця сума

(W·p+b*1)

є аргументом функції активації f а виходом функції активації є сигнал а.

Константи W і b є скалярними параметрами нейрона. Основний принцип роботи нейронної мережі полягає в настройці параметрів нейрона ,такщоб поведінка мережі відповідала деякій бажаній поведінці. Регулюючи ваги і параметри зсуву, можна навчити мережу виконувати конкретну роботу; можливо також, що мережа сама коректуватиме свої параметри, щоб досягти необхідного результату.

Рівняння нейрона із зсувом має вигляд

Як вже наголошувалося, зсув b - скалярний параметр нейрона, який не є входом, що настроюється. В цьому випадкуb - вага, а константа 1, яка управляє зсувом, розглядається як вхід і може бути врахована у вигляді лінійної комбінації векторів входу

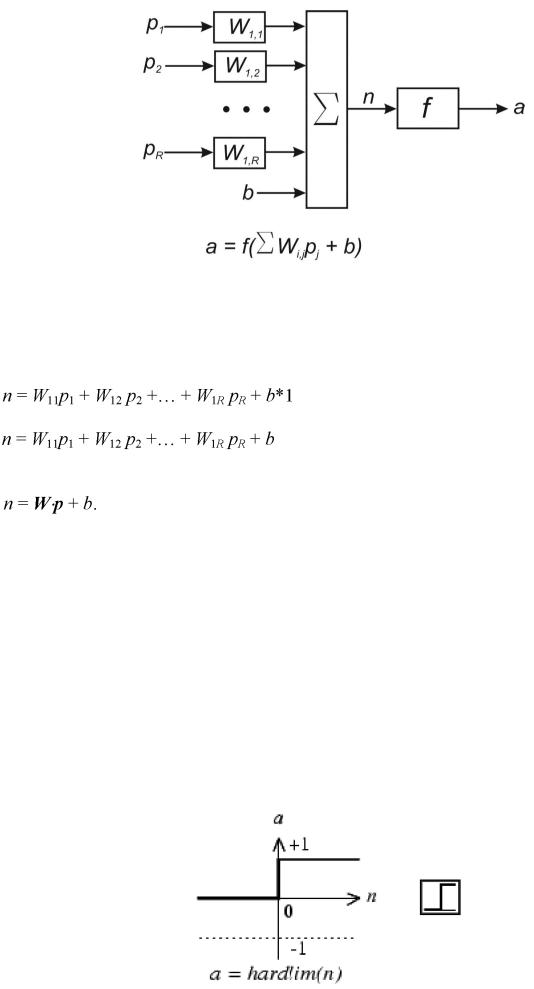

Нейрон персептрона. Нейрон з векторним входом

Нейрон з одним вектором входам з R елементами р1, р2., pR показаний на мал. 2.

1

Малюнок 2

Тут кожен елемент входу множиться на вагиWlh W12., W1R відповідно, і зважені значення передаються на суматор. Їх сума рівна скалярному твору вектора-рядкаW на вектор-стовпець входу р.

Нейрон має зсувb, яке підсумовується із зваженою сумою входів. Результуюча

сума

або

іслужить аргументом функції активації f.

Унотації мови MATLAB цей вираз записується так:

Входом п функції активації нейрона служить сума зсувуb і твір W·p. Ця сума перетвориться функцією активації f, на виході якої отримуємо вихід нейронаа, який в даному випадку є скалярною величиною.

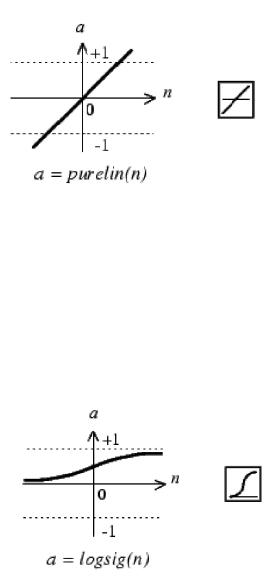

Функції активації

Функції активації (передавальні функції) нейрона можуть мати самий різний вигляд. Функція активації f, як правило, належить до класу сигмоїдальних функцій, які мають дві горизонтальні асимптоти і одна точка перегину, з аргументом функціїn (входом) і значенням функції(виходом) а. Розглянемо три найбільш поширені форми функції активації.

Одинична функція активації з жорстким обмеженням hardlim

Ця функція описується співвідношенням а = hardlim(n)= 1(n) і показана на мал. 3.

Малюнок 3

2

Вона рівна 0, якщо n < 0, і рівна 1, якщо n×0. Щоб побудувати графік цієї функції в діапазоні значень входу від–5 до +5, необхідно ввести наступних операторів мови MATLAB в командному вікні:

n = -5:0.1:5; plot(n,hardlim(n),'b+:');

Лінійна функція активації purelin

Дана функція описується відношенням a=purelin(n)=n та показана на мал.4.

Малюнок 4

Щоб побудувати графік цієї функції в діапазоні значень входу–5віддо +5, необхідно ввести наступних операторів мови MATLAB в командному вікні:

n = -5:0.1:5; plot(n,purelin(n),'b+:');

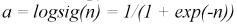

Логістична функція активації logsig

Дана функція описується відношенням  та показана на мал. 5.

та показана на мал. 5.

Малюнок 5

Дана функція належить до класу сигмоїдальних функцій, її аргумент може приймати будь-яке значення в діапазоні від – Х до +Х, а вихід змінюється в діапазоні від 0 до 1. Завдяки властивості диференційованості (немає точок розриву) ця функція часто використовується в мережах з навчанням на основі методу зворотного розповсюдження помилки.

Щоб побудувати графік цієї функції в діапазоні значень входу–5віддо +5, необхідно ввести наступних операторів мови MATLAB в командному вікні:

n=-5:0.1:5; plot(n,logsig(n),'b+:');

3

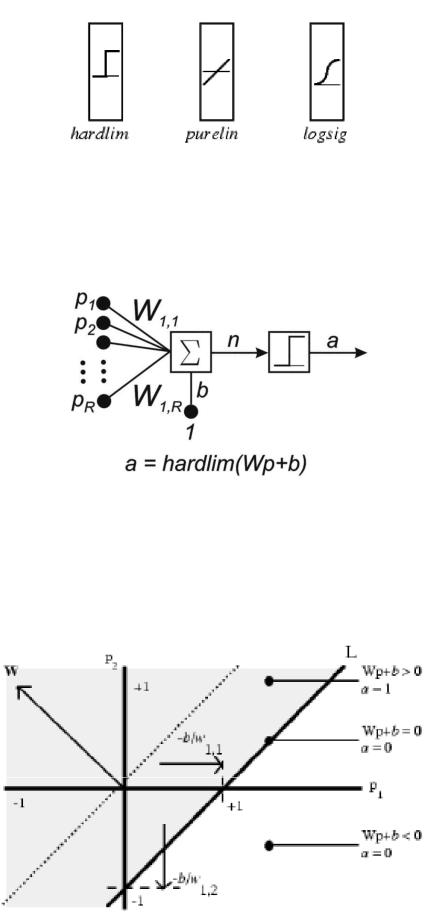

На укрупненій структурній схемі для позначення типу функції ак застосовуються спеціальні графічні символи; деякі з них приведені на мал. 6.

Малюнок 6

Нейрон, використовуваний в моделі персептрона, має ступінчасту функцію активації hardlim з жорсткими обмеженнями (мал. 7, використано спрощене зображення нейрона).

Малюнок 7

Кожне значення елементу вектора входу персептрона помножене на відповідну вагу Wij, і сума отриманих зважених елементів є входом функції активації. Якщо вхід функції активації п≥0, то нейрон персептрона повертає 1, якщо п<0, то 0.

Функція активації з жорсткими обмеженнями додає персептрону зда класифікувати вектори входу, розділяючи простір входів на дві області, як це показано на мал. 8, для персептрона з двома входами і зсувом.

Малюнок 8

4

Простір входів ділиться на дві області розділяючою |

L,лінієюяка для |

двовимірного випадку задається рівнянням |

|

Wт·p + b = 0. |

|

Ця лінія перпендикулярна до вектора вагівW і зміщена на величинуb. Вектори |

|

входу вище лініїL відповідають позитивному потенціалу нейрона, і, |

отже, вихід |

персептрона для цих векторів буде рівний1; вектори входу нижче лініїL відповідають виходу персептрона, рівному 0.

При зміні значень зсуву і вагів межа лінії L змінює своє положення.

Персептрон без зсуву завжди формує розділяючу лінію, що проходить через початок координат; додавання зсуву формує лінію, яка не проходить через початок координат. У разі, коли розмірність вектора входу перевищує2, тобто вхідний вектор р має більше 2 елементів, розділяючою межею служитиме гіперплощина.

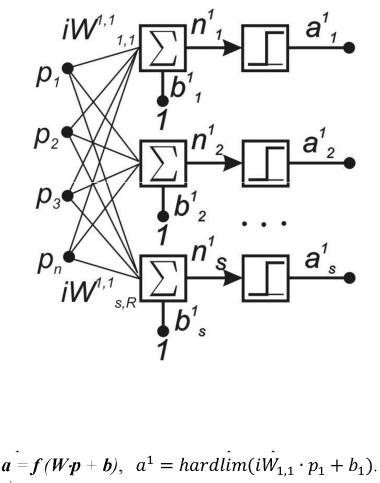

Персептрон

Персептроном називається проста нейронна мережа, ваги і зсуви якої можуть бути настроєні так, щоб вирішити задачу класифікації вхідних векторів. Завдання класифікації дозволяють вирішувати складні проблеми аналізу комутаційних з'єднань, розпізнавання образів і інших завдань класифікації з високою швидкодією і гарантією правильног результату.

Малюнок 9

Персептрон складається з єдиного шару, включаючого S нейронів, як це показано на мал. 9; ваги Wij - це коефіцієнти передачі від j-го входу до i-го нейрона.

Рівняння одношарового персептрона має вигляд

Архітектура мережі |

|

мал. 9, називається шаром |

мережі. Шар |

|

Структурна схема, приведена на |

||||

характеризується |

матрицею |

вагівW, |

зсувом b, операціями |

множення W·p, |

5