Материал: 6593

81

двух случайных функций. Тогда ε -энтропией Hερ [X (t)] слу-

чайной функции X(t) называется минимальное среднее количество взаимной информации в единицу времени между X(t) и Z(t),

необходимое для того, чтобы ρ(X , Z) ≤ ε .

Часто в качестве меры отличия используют среднеквадратическую ошибку воспроизведения стационарной случайной функции X(t) при помощи стационарной и стационарно связанной с ней случайной функции Z(t)

|

|

|

|

(3.3.5) |

|

|

2 |

||

ρ0 (X , Z) = M (X − Z) |

. |

|

||

Если Z(t) – это цифровой сигнал, то ε -энтропия численно равна минимальному среднему количеству двоичных символов в единицу времени, необходимых для восстановления функции X(t) со среднеквадратической ошибкой, не превышающей ε .

Для нормальной стационарной случайной функции X(t), имеющей спектр плотности мощности G(f), ε -энтропия при

среднеквадратическом критерии точности (3.3.5) вычисляется по формуле

Hε0 [X (t)]= ∫log G( f ) df , |

(3.3.6) |

∆f λ

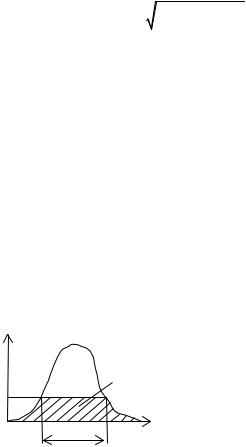

где ∆f - полоса частот, в которой G( f ) ≥ λ . Коэффициент λ

выбирается таким образом, чтобы площадь фигуры, ограниченной снизу осью f, а сверху – прямой G= λ (в области ∆f ) либо

кривой G(f) (вне области штрихована на рис. 3.3.1.

G(f)

ε2

λ

f f

Рис. 3.1

∆f ), была равна ε 2 . Эта фигура з а-

Понятие ε - энтропии может быть применено и к последовательности дискретных случайных величин.

При вычислении ε -энтропии случайной величины X, когда расстояние между X и Z задано в виде математического ожидания некоторой функции

82

ρ(X , Z) = M[ϕ(V )] |

(3.3.7) |

их разности V=X-Z, справедливо соотношение

H (X Z) = H (V Z) ≤ H (V ) . |

(3.3.8) |

Оно показывает, что средняя условная энтропия ошибки при заданном ограничении ρ ≤ ε достигает максимального

значения, когда X и Z независимы. Это требование, однако, не является достаточным.

РЕШЕНИЕ ТИПОВЫХ ПРИМЕРОВ Пример 3.3.1. Нормальный стационарный узкополосный

случайный процесс, имеющий корреляционную функцию

B(τ) = |

|

|

1 |

cos 2πf0τ , |

|

1 |

+ a2τ 2 |

||||

|

|

||||

пропускают через идеальный фильтр с полосой, заключённой в интервале частот от f1 = f0 − F до f2 = f0 + F . Найти отно-

сительную энтропию в единицу времени для процесса на выходе фильтра.

Решение. Односторонний спектр плотности мощности исходного процесса в соответствии с теоремой Винера-Хинчина равен преобразованию Фурье от корреляционной функции

G( f ) = 2 |

∞∫ B(τ)cos 2π fτdτ = 2 |

∞∫ |

1 |

cos 2π |

( f − f0 )τdτ. |

|||||||||||||

2 2 |

||||||||||||||||||

|

|

−∞ |

|

|

|

|

|

|

−∞ |

1+ a |

τ |

|

|

|

|

|

|

|

Этот интеграл – табличный: |

|

|

|

|

|

|

|

|

|

|

||||||||

G( f ) = |

π |

|

|

|

2π |

( f − f0 ) |

|

|

|

|

|

2π |

( f + |

f0 ) |

|

|

, f ≥ 0. |

|

|

|

|

|

|

||||||||||||||

a |

exp − |

|

a |

|

+exp − |

|

a |

|

|

|||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

||||||||

Поскольку процесс узкополосен, то справедливо соотношение f 0 >>a, поэтому в полученном выражении можно пренебречь вторым слагаемым и получим

G( f ) ≈ |

π |

|

− |

|

2π |

( f − f0 ) |

|

|

, f ≥ 0. |

|

|

||||||||

exp |

|

|

|

|

|||||

|

a |

|

|

|

a |

|

|

|

|

|

|

|

|

|

|

||||

Спектр плотности мощности процесса на выходе идеального полосового фильтра равен

|

|

|

|

83 |

|

|

|

|

|

||

Gâû õ ( f ) = |

π |

|

− |

|

2π |

( f − f0 ) |

|

|

, f1 |

≤ |

f ≤ f2. |

|

|

||||||||||

exp |

|

|

|

|

|||||||

|

a |

|

|

|

a |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

Величину относительной энтропии на один отсчёт вычисляем по формуле (3.3.3)

|

|

|

|

1 |

|

|

f2 |

|

|

|

|

|

|

|

2π |

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

H [X (t)]= |

|

|

|

∫ln a exp |

− |

|

a ( f |

− f0 ) |

|

df + |

||||||||||||||||||

2( f |

|

− f ) |

||||||||||||||||||||||||||

|

|

|

|

2 |

1 |

|

|

f1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||

+ |

1 |

ln[2πe( f2 − f1)] |

= |

1 |

|

ln |

2π2e |

( f2 |

|

+ |

f2 |

|

|

2π |

( f − f0 ) |

|

|

|||||||||||

|

|

|

||||||||||||||||||||||||||

2 |

2 |

|

a |

|

− f1) |

∫f |

− |

|

a |

|

df . |

|||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1 |

|

|

|

|

|

|

|

|

|

|

Далее учитываем, |

|

что |

f2 − f0 |

= f0 − f1 = F и, |

осуществив |

||||||||||||||||||||||

интегрирование, получим |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

|

|

H[X (t)] |

= |

1 |

ln |

4π2eF |

− |

2πF 2 |

|

|

í àò |

|

. |

|

|

|||||||||||||

|

|

2 |

|

a |

|

|

a |

|

|

î òñ÷¸ò |

|

|

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

|

В одну секунду берется |

n = 2∆F = 4F |

|

отсчётов, поэтому |

||||||||||||||||||||||||

относительная энтропия в единицу времени равна |

|

|

|

|

||||||||||||||||||||||||

|

|

H[X (t)] = 2F ln |

4π2eF |

− |

8πF 2 |

í àò |

. |

|

|

|

|

|

|

|

||||||||||||||

|

|

|

|

a |

|

|

|

a |

ñ |

|

|

|

|

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

Пример 3.3.2. Уровень воды в водоёме U(t) меняется со временем так, что он полностью определяется отсчётами, взятыми через полгода. Отдельные отсчёты независимы и имеют одностороннее экспоненциальное распределение с математическим ожиданием, равным 4 м. При учёте запаса воды допустимы только положительные ошибки v=u-z, причём среднее значение ошибки не должно превышать 0,25 м.

Найти ε-энтропию функции U(t).

Решение. Задача заключается в вычислении минимального среднего количества информации, которое необходимо передавать в год для воспроизведения функции U(t) при помощи другой функции с заданной точностью. За год уровень воды измеряется два раза, и эти отсчёты независимы, поэтому можно вычислить ε -энтропию одного отсчёта и, пользуясь свойством аддитивности ε -энтропии, удвоить полученный результат.

Средняя взаимная информация между U и Z равна

I(U; Z) = H (U ) − H (U Z) .

Z) .

84

Относительная энтропия экспоненциально распределённой положительной случайной величины U равна (см. пример

(3.2.1))

H (U ) = log2 (emu ) = log2 (4e) бит.

В условии задачи расстояние между X и Z задано в виде математического ожидания их разности, поэтому средняя условная энтропия H(U/Z) достигает максимального значения, когда V и Z независимы (см. неравенство (3.3.8)). Далее необходимо в классе распределений W(v) положительной случайной величины V, удовлетворяющих заданному в условии задачи ограничению

1)M[V ] = ∞∫vW (v)dv ≤ 0,25

0

иусловию нормировки

2)∞∫W (v)dv =1,

0

найти такое распределение, которое обладает наибольшей энтропией.

Как следует из примера 3.2.3, случайная величина V при этих ограничениях также должна иметь одностороннее экспоненциальное распределение

W (v) = |

|

1 |

exp(− |

v |

), v > 0. |

|

0,25 |

0,25 |

|||||

|

|

|

||||

Тогда H (U Z)max |

|

= H (V )max |

= log2 (0,25e) бит, |

|||

и ε -энтропия на один отсчёт равна |

||||||

Hερ (U ) = I(U; Z)min |

= log2 (4e) −log2 (0, 25e) = 4 бит отсчёт. |

|||||

Для ε -энтропии случайной функции U(t) окончательно по-

лучим Hερ[U (t)] = 8 бит год.

год.

ЗАДАЧИ

3.3.1.Радиосигнал подаётся на усилитель, имеющий коэффициент передачи K(f) = 1000. Насколько изменится энтропия на 1 отсчёт выходного сигнала по сравнению с входным.

3.3.2.Сигнал на выходе микрофона стационарен, имеет

85

среднюю мощность 10−6 Вт, а его энергетический спектр заключён в полосе частот 100 – 5000 Гц. Найти наибольшее возможное значение относительной энтропии такого сигнала:

а) на один отсчёт, б) в 1 мин.

3.3.3.Вычислить «энтропийную мощность» сигнала U(t) из примера 3.3.2., полагая, что этот сигнал имеет ограниченный спектр.

3.3.4.Радиосигнал, спектр которого заключён в полосе частот 100 – 300 МГц, подаётся на усилитель промежуточной ча-

стоты, имеющий амплитудно-частотную характеристику колокольной формы

K( f ) =105 exp[− ( f − f0 )2 ] (∆f )2

с центральной частотой f0 = 200 МГц и полосой пропус- ка-ния ∆f = 20 МГц.

Вычислить, насколько изменится энтропия выходного сигнала по сравнению с входным.

3.3.5. Отсчёты сигнала U(t) из примера 3.3.2 подвергаются равномерному квантованию с шагом 2 м. Найти величину взаимной информации в единицу времени между исходным и квантованным сигналами.

3.3.6*. Вычислитьε - энтропию нормальной случайной ве- ли-чины X, имеющей параметры m = 5 и σ = 8 , если допусти-

ма среднеквадратическая ошибка представления этой величины равная 1. Найти условную плотность вероятности W(z/x) для воспроизводящей величины Z.

3.3.7.Вычислить ε - энтропию равномерно распределённой

винтервале 0 – 2 случайной величины, если при воспроизведе-

нии допустима ошибка, не превышающая по модулю 0,01. Объяснить полученный результат и указать способ воспроизведения с требуемой точностью.

3.3.8. Получить формулу относительной энтропии на один