Материал: 3744

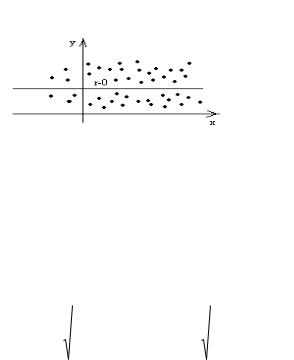

3) при r 0 линейная связь отсутствует (рис.), при этом близость к нулю не означает отсутствия связи между признаками, она может оказаться достаточно тесной.

Рисунок 2. Отсутствие связи

В случае парной регрессии для практических расчетов наиболее удобная формула:

|

|

|

|

|

|

|

|

|

|

|

n |

|

|

n |

n |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

n xi yi |

xi |

yi |

|

|

||||

|

|

xy x y |

|

|

|

|

|

||||||||||||

r |

|

|

|

|

i 1 |

|

|

i 1 |

i 1 |

|

|

|

|||||||

|

x y |

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

n |

n |

2 |

|

|

n |

|

n |

2 |

|

|||||||||

|

|

|

|

|

|

|

|

||||||||||||

|

|

|

|

|

|

|

|

2 |

|

|

|

|

|

2 |

|

|

|

||

|

|

|

|

|

|

|

|

|

|

n xi |

xi |

|

n yi |

yi |

|

||||

|

|

|

|

|

|

|

|

|

|

i 1 |

i 1 |

|

|

|

i 1 |

i 1 |

|

|

|

т.к. по этой формуле r находится непосредственно из данных наблюдений, и на значении r не скажутся округление данных, связанные с расчетом средних и отклонений от них.

Задачи регрессионного анализа

С помощью уравнения регрессии y=ƒ(x1,x2,…xħ), , можно измерить влияние отдельных факторов на зависимую переменную, что делает анализ конкретным, существенно повышает его познавательную ценность, уравнения регрессии также применяются в прогнозных работах.

Построение уравнения регрессии предполагает решение двух основных задач. Первая задача заключается в выборе независимых переменных, оказывающих существенное влияние на зависимую величину, атакже в

определении |

вида |

уравнения |

регрессии. |

Вторая задача |

построения уравнения |

регрессии – оценивание |

параметров |

(коэффициентов) уравнения. В связи с тем, что оценки параметров уравнения являются выборочными характеристиками, в процессе оценивания необходимо проводить статистическую проверку существенности полученных параметров.

26

Метод наименьших квадратов

При оценке параметров уравнения регрессии применяется метод наименьших квадратов (МНК). Смотрим применение МНК на примере однофакторной линейной регрессии y a bx .

Согласно МНК поиск наилучшей аппроксимации набора наблюдений линейной функцией сводится к минимизации функционала

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

g yi a bxi 2 . |

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|

|

i 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Необходимые условия экстремума: |

|

|

|

|

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

g 2 yi |

a bxi 0 , |

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

a |

|

|

i 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

g |

|

|

n |

|

a bxi xi 0 , |

|

|

|

||||||||||

|

|

|

|

|

2 yi |

|

|

|

|||||||||||||||

|

|

|

|

|

b |

|

|

i 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

или |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

yi |

a bxi |

0 |

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

i 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

xi 0 |

|

|

|

|

||||||

|

|

|

|

|

|

|

yi |

a bxi |

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|

i 1 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Введем обозначения: |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

n |

|

|

|

|

|

|

|

1 |

n |

|

|

|

1 |

n |

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||

|

x |

1 xi |

, y 1 yi , |

xy |

xi yi , x |

2 |

xi2 . |

||||||||||||||||

|

|

|

|

|

|

|

|

|

n |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

n i 1 |

|

|

|

|

|

|

|

|

n i 1 |

|

|

|

|

n i 1 |

||||||

|

|

|

|

|

|

n i 1 |

|

|

|

|

|

|

|

||||||||||

Обозначения: |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

_ 2 |

|

|

|

|

|

выборочной дисперсии переменной x: x2 |

x2 |

|

|

|

|

||||||||||||||||||

x |

; |

|

|

|

|||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

_ 2 |

|

|

|

|

|

выборочной дисперсии переменной y: y2 |

y 2 |

|

|

|

|

||||||||||||||||||

y |

; |

|

|

|

|||||||||||||||||||

выборочной ковариации cov x, y yx y x .

В новых обозначениях система определения a и b принимает вид:

27

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

a bx y |

|

|

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

x |

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

2 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ax bx |

|

xy |

|

|

|

|

|

|

|

|||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||

Тогда |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

cov x, y |

|

|

|

|

|

|

|

|||||||||

|

|

|

|

|

|

b |

|

x y xy |

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

a |

y bx , |

||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

, |

|||||||||||||||

|

|

|

_ |

2 |

|

|

|

|

|

|

|

|

|

|

|

|

2 |

|

|||||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

x |

|

|

x2 |

|

|

|

|

|

|

|

x |

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||||||

при x 0 |

a |

y |

, если x 0 , то указанная трактовка a не имеет смысла и, |

||||||||||||||||||||||||||||||||||||

соответственно, может не иметь экономического содержания. |

|||||||||||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|||||||||||||||||||||||||||||||||

Из уравнения y a bx для |

определения |

параметра a следует, что |

|||||||||||||||||||||||||||||||||||||

уравнение прямой y a bx проходит через точку x, y .

При выполнении линейного регрессионного анализа делаются определенные предпосылки относительно случайной составляющей

y a b1 x1 b p x p ,

где - ненаблюдаемая величина (остаток регрессии).

После того, как произведена оценка параметров модели, рассчитывая разности фактических и теоретических значений y , можно определить оценки случайной составляющей y yтеор . Поскольку они не являются реальными случайными остатками, их можно считать некоторой выборочной реализацией неизвестного остатка заданного уравнения, т.е. i . При изменении спецификации модели, добавлении в неѐ новых наблюдений, выборочные оценки остатков i могут меняться. Поэтому в задачу регрессионного анализа входит не только построение самой модели, но и исследование случайных отклонений i , т.е. остатков.

До сих пор мы останавливались на формальных проверках статистической достоверности коэффициентов регрессии и корреляции с помощью t - критерия Стьюдента, F - критерия Фишера. Оценки параметров регрессии должны отвечать определенным критериям. Они должны быть несмещенными, состоятельными и эффективными.

28

Несмещенность оценки означает, что математическое ожидание остатков равно нулю. Следовательно, при большом числе выборочных оценивании, остатки не будут накапливаться и найденный параметр b можно рассматривать как среднее значение из возможного большого числа несмещенных оценок.

Эффективность оценки – оценки, характеризующиеся наименьшей дисперсией.

Состоятельность оценок характеризует увеличение их точности с увеличением выборки.

Указанные критерии должны учитываться при разных способах оценивания. МНК строит оценки регрессии на основе минимизации суммы квадратов остатков. Поэтому очень важно исследовать поведение остатков регрессии i .

Исследования остатков i предполагают проверку наличия следующих предпосылок МНК (т.е. предполагается получение несмещенных эффективных

исостоятельных оценок):

1.случайный характер остатков

2.нулевая средняя величина i , не зависящая от xi

3.гомоскедастичность – дисперсия каждого i одинакова для всех

значений x

4.отсутствие автокорреляции остатков. Значения остатков i

распределены независимо друг от друга.

5. остатки подчиняются нормальному распределению.

Оценка значимости уравнения регрессии

Проверить значимость уравнения регрессии - значит установить,

соответствует ли математическая модель, выражающая зависимость между переменными, экспериментальным данным и достаточно ли включенных в уравнение объясняющих переменных (одной или нескольких) для описания зависимой переменной.

Проверка значимости уравнения регрессии производится на основе дисперсионного анализа.

^

Обозначим через y a bx - теоретически вычисляемые по формуле значения, тогда

29

|

|

|

|

^ ^ |

^ |

^ |

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

yi y yi y yi yi yi yi |

yi y |

|||||||

|

|

|

|

|

|

|

|

|

Введем обозначения:

TSS (totalsumofsguares) – вся дисперсия: сумма квадратов отклонений от среднего.

RSS (regressionsumofsguares) – объясненная часть всей дисперсии (обусловленная регрессией), факторная, объясненная дисперсия.

ESS (errorsumofsguares) – остаточная сумма, дисперсия остаточная.

Коэффициентом детерминации R2 , или долей объясненной дисперсии называется

|

|

|

R2 1 |

ESS |

|

RSS |

|

|

|

|

|

|

|||

|

|

|

|

|

|

. |

|

|

|

|

|

|

|||

|

|

|

TSS |

TSS |

|

|

|

|

|

|

|||||

В силу определения R2 : 0 R2 |

1. |

|

|

|

|

|

|

|

|

|

|||||

Если R2 0 , то это означает, |

что регрессия ничего не дает, |

т.е. x |

i |

не |

|||||||||||

|

|

|

|

|

|

|

|

|

|

^ |

|

|

|

|

|

улучшает качество предсказания yi , по сравнению с тривиальным |

yi |

y . |

|

|

|||||||||||

Если R2 1, то x |

, y |

|

лежат на линии регрессии и между x и y существует |

||||||||||||

i |

i |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

линейная функциональная |

зависимость, т.е. |

абсолютно точное |

совпадение: |

||||||||||||

^

yi yi .

Соответственно коэффициент линейной регрессии (как парной так и множественной)

|

|

|

|

|

|

|

|

n |

^ |

2 |

|

|

|

|

|

|

|

|

|

|

yi |

yi |

|

||

|

|

|

|

|

|

|

|

|

||||

R |

|

|

RSS |

|

|

1 |

i 1 |

|

|

|

|

|

xy |

|

n |

|

|

|

. |

||||||

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

TSS |

|

yi |

|

|

2 |

|

||

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

y |

|

|||

|

|

|

|

|

|

|

|

i 1 |

|

|

|

|

Использование F-критерия

С помощью F-критерия можно оценить качество построенной функции y a bx .

Разделив каждую сумму квадратов на соответствующее ей число степеней свободы, получим средний квадрат отклонений, или, что тоже самое, дисперсию на одну степень свободы D

30